Дистрибутивна семантика

| Ця стаття є сирим перекладом з англійської мови. Можливо, вона створена за допомогою машинного перекладу або перекладачем, який недостатньо володіє обома мовами. (лютий 2024) |

Дистрибутивна семантика[1] — це галузь досліджень, що розробляє та вивчає теорії та методи кількісної оцінки та категоризації семантичних подібностей між мовними елементами на базі їхніх дистрибутивних властивостей у великих вибірках мовних даних. Базова ідея дистрибутивної семантики може бути підсумована в так званій дистрибутивній гіпотезі: лінгвістичні елементи з подібними дистрибуціями мають подібні значення.

Дистрибутивна гіпотеза[ред. | ред. код]

Дистрибутивна гіпотеза в лінгвістиці походить від семантичної теорії вживання мови, наприклад слова, які вживаються та трапляються в однакових контекстах, як правило, мають подібні значення.[2]

Ключова ідея, що «слово характеризується компанією, яку воно підтримує», була популяризована Фертом у 1950-х роках.[3]

Дистрибутивна гіпотеза є базою статистичної семантики . Хоча вона й виникла в лінгвістиці[4], зараз вона отримує увагу в когнітивній науці, особливо щодо контексту вживання слів.[5]

За останні роки дистрибутивна гіпотеза стала базою для теорії узагальнення на основі подібності у вивченні мови: ідея, що діти можуть зрозуміти як використовувати слова, які вони рідко зустрічали раніше, узагальнюючи їх використання на основі дистрибуції подібних слів.[6][7]

Дистрибутивна гіпотеза припускає, що чим більш семантично схожими є два слова, тим більш дистрибутивно схожими вони будуть, і, отже, тим більше вони будуть мати тенденцію зустрічатися в подібних мовних контекстах.

Незалежно від того, чи справедливе це припущення, воно має значні наслідки як для проблеми розрідженості даних в обчислювальному моделюванні, так і для питання про те, як діти здатні вивчати мову так швидко, враховуючи відносно бідні вхідні дані (це також відоме як проблема бідності стимулу).

Дистрибутивне семантичне моделювання у векторних просторах[ред. | ред. код]

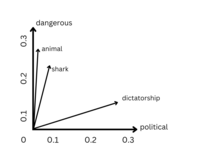

Дистрибутивна семантика сприяє застосуванню лінійної алгебри як обчислювального інструменту та фреймворку представлення. Базовий підхід полягає у зборі дистрибутивної інформації у великорозмірних векторах та визначенні дистрибутивної/семантичної схожості в термінах векторної схожості.[8] Залежно від того, який тип інформації про дистрибуцію використовується для збирання векторів, можна виокремлювати різні види схожостей: тематичні схожості можна витягнути, заповнивши вектори інформацією про те, в яких областях тексту зустрічаються лінгвістичні елементи; парадигматичні схожості можна витягнути, заповнивши вектори інформацією про те, з якими іншими мовними елементами елементи зустрічаються. Зверніть увагу, що останній тип векторів також можна використовувати для вилучення синтагматичних схожості, дивлячись на окремі векторні компоненти.

Базова ідея кореляції між дистрибутивною та семантичною схожістю може бути реалізована багатьма різними способами. Є великий асортимент обчислювальних моделей, які реалізують дистрибутивну семантику, включаючи латентний семантичний аналіз (LSA),[9][10] аналог мови гіперпростору (HAL), моделі на основі синтаксису або залежностей,[11] випадкове індексування, семантичне згортання[12] та різні варіанти тематичної моделі .[13]

Дистрибутивні семантичні моделі відрізняються, перш за все, такими параметрами:

- Вид контексту (текстові регіони чи мовні елементи)

- Контекстне вікно (розмір, розширення тощо)

- Частотне зважування (наприклад, ентропія, поточкова взаємна інформація[14] тощо)

- Зменшення розмірності (наприклад, випадкове індексування, розклад сингулярного значення тощо)

- Міра подібності (наприклад, косинус подібності, відстань Мінковського тощо)

Дистрибутивні семантичні моделі, що застосовують лінгвістичні елементи як контекст, ще називають простором слів або моделями векторного простору.[15][16]

Поза межами лексичної семантики[ред. | ред. код]

Під час того як дистрибутивна семантика зазвичай використовується для лексичних одиниць — слів та багатослівних термінів — із значним успіхом, не в останню чергу завдяки її використанню як вхідних даних для нейронно інспірованих моделей глибокого навчання, лексична семантика (значення слів), тільки щоб нести частину семантики цілого висловлювання. Значення речення, наприклад «Тигри люблять кроликів», можна зрозуміти тільки частково, вивчивши значення трьох лексичних одиниць, які воно містить. Дистрибутивну семантику можна просто розширити, щоб охопити більший лінгвістичний елемент, такий як конструкції, з елементами без екземплярів або без них, але деякі базові припущення моделі потрібно дещо скоригувати. Граматика побудови та її формулювання лексико-синтаксичного континууму пропонують один підхід для включення більш складних конструкцій у семантичну модель розподілу, а деякі експерименти були реалізовані з використанням підходу випадкового індексування.[17]

Композиційні семантичні моделі розподілу розширюють семантичні моделі дистрибуції завдяки явним семантичним функціям, що застосовують синтаксично започатковані правила щоб об'єднати семантики лексичних одиниць, які беруть участь, у композиційну модель для характеристики семантики повних фраз чи речень. Цю роботу спершу запропонували Стівен Кларк, Боб Коеке та Мехрунш Садрзаде з Оксфордського університету, в їхній статті 2008 року «Композиційна модель розподілу значення».[18] Було досліджено різні підходи до композиції, включаючи нейронні моделі, і вони обговорюються на відомих семінарах, таких як SemEval .[19]

Додатки[ред. | ред. код]

Моделі дистрибутивної семантики успішно застосовуються для наступних завдань:

- знаходження дистрибутивної подібності між словами та багатослівними виразами;

- кластеризація слів на основі семантичної подібності;

- автоматичне створення тезаурусів і двомовних словників;

- неоднозначність сенсу слова ;

- розширення пошукових запитів за допомогою синонімів та асоціацій;

- визначення теми документа;

- кластеризація документів для пошуку інформації ;

- інтелектуальний аналіз даних та розпізнавання іменованих об'єктів ;

- створення семантичних карт різних предметних областей;

- перефразування ;

- аналіз настроїв ;

- моделювання вибіркових переваг слів.

Програмне забезпечення[ред. | ред. код]

Див. також[ред. | ред. код]

Люди[ред. | ред. код]

Примітки[ред. | ред. код]

- ↑ Lenci, Alessandro; Sahlgren, Magnus (2023). Distributional Semantics. Cambridge University Press. ISBN 9780511783692.

- ↑ (Harris, 1954)

- ↑ (Firth, 1957)

- ↑ (Sahlgren, 2008)

- ↑ (McDonald та Ramscar, 2001)

- ↑ (Gleitman, 2002)

- ↑ (Yarlett, 2008)

- ↑ (Rieger, 1991)

- ↑ (Deerwester та ін., 1990)

- ↑ Landauer, Thomas K.; Dumais, Susan T. (1997). A solution to Plato's problem: The latent semantic analysis theory of acquisition, induction, and representation of knowledge. Psychological Review. 104 (2): 211—240. doi:10.1037/0033-295x.104.2.211.

- ↑ (Padó та Lapata, 2007)

- ↑ De Sousa Webber, Francisco. «Semantic Folding Theory And its Application in Semantic Fingerprinting». MISSING LINK. .

- ↑ Jordan, Michael I.; Ng, Andrew Y.; Blei, David M. (2003). Latent Dirichlet Allocation. Journal of Machine Learning Research. 3 (Jan): 993—1022.

- ↑ Church, Kenneth Ward; Hanks, Patrick (1989). Word association norms, mutual information, and lexicography. Proceedings of the 27th Annual Meeting on Association for Computational Linguistics. Morristown, NJ, USA: Association for Computational Linguistics: 76—83. doi:10.3115/981623.981633.

- ↑ (Schütze, 1993)

- ↑ (Sahlgren, 2006)

- ↑ Karlgren, Jussi; Kanerva, Pentti (July 2019). High-dimensional distributed semantic spaces for utterances. Natural Language Engineering. 25 (4): 503—517. arXiv:2104.00424. doi:10.1017/S1351324919000226.

- ↑ Clark, Stephen; Coecke, Bob; Sadrzadeh, Mehrnoosh (2008). A compositional distributional model of meaning (PDF). Proceedings of the Second Quantum Interaction Symposium: 133—140.

- ↑ SemEval-2014, Task 1.

Джерела[ред. | ред. код]

- Harris, Z. (1954). Distributional structure. Word. 10 (23): 146—162. doi:10.1080/00437956.1954.11659520.

- Firth, J.R. (1957). A synopsis of linguistic theory 1930-1955. Studies in Linguistic Analysis: 1—32. Reprinted in F.R. Palmer, ред. (1968). Selected Papers of J.R. Firth 1952-1959. London: Longman.

- Lenci, Alessandro; Sahlgren, Magnus (2023). Distributional Semantics. Cambridge University Press. ISBN 9780511783692.

- Sahlgren, Magnus (2008). The Distributional Hypothesis (PDF). Rivista di Linguistica. 20 (1): 33—53.

- Gleitman, Lila R. (2002). Verbs of a feather flock together II. The Legacy of Zellig Harris. Current Issues in Linguistic Theory. Т. 1. с. 209—229. doi:10.1075/cilt.228.17gle. ISBN 978-90-272-4736-0.

- Deerwester, Scott; Dumais, Susan T.; Furnas, George W.; Landauer, Thomas K.; Harshman, Richard (1990). Indexing by Latent Semantic Analysis (PDF). Journal of the American Society for Information Science. 41 (6): 391—407. CiteSeerX 10.1.1.33.2447. doi:10.1002/(SICI)1097-4571(199009)41:6<391::AID-ASI1>3.0.CO;2-9. Архів оригіналу (PDF) за 17 липня 2012.

- Padó, Sebastian; Lapata, Mirella (2007). Dependency-based construction of semantic space models. Computational Linguistics. 33 (2): 161—199. doi:10.1162/coli.2007.33.2.161.

- Thomas Landauer; Susan T. Dumais. A Solution to Plato's Problem: The Latent Semantic Analysis Theory of Acquisition, Induction, and Representation of Knowledge. Процитовано 2 липня 2007.

- Kevin Lund; Curt Burgess (1996). Producing high-dimensional semantic spaces from lexical co-occurrence. Behavior Research Methods, Instruments, and Computers. 28 (2): 203—208. doi:10.3758/bf03204766.

Посилання[ред. | ред. код]

|