Китайська кімната: відмінності між версіями

| [неперевірена версія] | [неперевірена версія] |

Немає опису редагування |

Немає опису редагування |

||

| Рядок 1: | Рядок 1: | ||

'''Аргуме́нт кита́йської кімна́ти''' стверджує, що виконання програми не може бути «[[розум]]ом», «[[Інтенціональність|розумінням]]» або «[[Свідомість|свідомістю]]» |

'''Аргуме́нт кита́йської кімна́ти''' стверджує, що виконання програми не може бути «[[розум]]ом», «[[Інтенціональність|розумінням]]» або «[[Свідомість|свідомістю]]» незалежно від того, наскільки програма забезпечує комп'ютеру поведінку розумної людини. Цей аргумент був вперше представлений філософом [[Джон Серль|Джоном Серлем]] у своїй роботі «Minds, Brains, and Programs» («Розум, мізки і програми»), опублікованій в 1980 році в журналі ''{{нп|Behavioral and Brain Sciences|Behavioral and Brain Sciences|en|Behavioral_and_Brain_Sciences}}''. З тих пір він широко обговорювався.{{sfn|Harnad|2001|p=1}} Центральним елементом аргументу є [[Уявний_експеримент|уявний експеримент]], відомий як '''китайська кімната'''.<ref name="Roberts">{{cite journal|last1=Roberts|first1=Jacob|title=Thinking Machines: The Search for Artificial Intelligence|journal=Distillations |date=2016|volume=2|issue=2|pages=14–23|url=https://www.sciencehistory.org/distillations/magazine/thinking-machines-the-search-for-artificial-intelligence|accessdate=22 March 2018}}</ref> |

||

Аргумент спрямований проти {{нп|Філософський рух|філософських позицій|en|Philosophical movement}} {{нп|Функціоналізм (філософія розуму)|функціоналізму|en|Functionalism_(philosophy_of_mind)}} та [[Комп%27ютерна_теорія_розуму|комп'ютерної теорії розуму]], які вважають, що розум можна розглядати як систему обробки інформації, що оперує формальними символами. Зокрема, аргумент намагається спростувати позицію, яку Серль називає ''[[Сильний штучний інтелект|сильним штучним інтелектом]]'': «Належним чином запрограмований комп'ютер з правильними вхідними і вихідними даними, матиме розум в точно такому ж сенсі, як людина має розум». |

Аргумент спрямований проти {{нп|Філософський рух|філософських позицій|en|Philosophical movement}} {{нп|Функціоналізм (філософія розуму)|функціоналізму|en|Functionalism_(philosophy_of_mind)}} та [[Комп%27ютерна_теорія_розуму|комп'ютерної теорії розуму]],{{sfn|Searle|1992|p=44}} які вважають, що розум можна розглядати як систему обробки інформації, що оперує формальними символами. Зокрема, аргумент намагається спростувати позицію, яку Серль називає ''[[Сильний штучний інтелект|сильним штучним інтелектом]]'': «Належним чином запрограмований комп'ютер з правильними вхідними і вихідними даними, матиме розум в точно такому ж сенсі, як людина має розум». |

||

Хоча аргумент китайської кімнати спочатку був представлений у відповідь на висловлювання дослідників [[Штучний_інтелект|штучного інтелекту]] (ШІ), він не є аргументом проти цілей дослідження ШІ, оскільки не обмежує силу інтелекту, яку може демонструвати машина. Аргумент застосовується тільки до цифрових комп'ютерів, на яких виконуються програми, і не поширюється на машини в цілому. |

Хоча аргумент китайської кімнати спочатку був представлений у відповідь на висловлювання дослідників [[Штучний_інтелект|штучного інтелекту]] (ШІ), він не є аргументом проти цілей дослідження ШІ, оскільки не обмежує силу інтелекту, яку може демонструвати машина.{{sfn|Russell|Norvig|2003|p=947}} Аргумент застосовується тільки до цифрових комп'ютерів, на яких виконуються програми, і не поширюється на машини в цілому.{{sfn|Searle|1980|p=11}} |

||

== Уявний експеримент == |

== Уявний експеримент == |

||

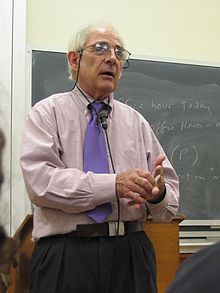

[[File:John searle2.jpg|thumb|Джон серль у грудні 2005]] |

|||

У популярній статті «Is the Brain's Mind a Computer Program?» («Чи є мозкове мислення комп'ютерною програмою?»), опублікованій у 1990 році, Серль описує експеримент таким чином: |

У популярній статті «Is the Brain's Mind a Computer Program?» («Чи є мозкове мислення комп'ютерною програмою?»), опублікованій у 1990 році, Серль описує експеримент таким чином: |

||

{{Цитата| |

{{Цитата| |

||

| Рядок 18: | Рядок 19: | ||

== Історія == |

== Історія == |

||

У 1714 р. [[Готфрід_Вільгельм_Ляйбніц|Готфрід Лейбніц]] зформував подібний аргумент проти {{нп|Механізм (філософія)|механізму|en|Mechanism (philosophy)}} (позиції про те, що розум є машиною і не більше). Лейбніц використовував уявний експеримент розширення мозку, поки він не став розміром з [[Млин (подрібнювач)|млин]]. Лейбніцю було важко уявити, що «розум», здатний до «сприйняття», може бути побудований з використанням тільки механічних процесів. У короткому оповіданні 1961 року «Гра» [[Анатолій Дніпров|Анатолія Дніпрова]] стадіон людей виступає перемикачами та осередками пам'яті, які реалізують програму перекладу фрази португальської мови, яку ніхто з них не знає. У 1974 році Лоуренс Девіс уявляв собі дублювання мозку за допомогою телефонних ліній і офісів, у яких працювали люди, і в 1978 році Нед Блок передбачив, що все населення Китаю бере участь у такому моделюванні мозку. Цей розумовий експеримент називається Китайський мозок, також "китайська нація" або "китайський тренажерний зал". |

У 1714 р. [[Готфрід_Вільгельм_Ляйбніц|Готфрід Лейбніц]] зформував подібний аргумент проти {{нп|Механізм (філософія)|механізму|en|Mechanism (philosophy)}} (позиції про те, що розум є машиною і не більше). Лейбніц використовував уявний експеримент розширення мозку, поки він не став розміром з [[Млин (подрібнювач)|млин]].<ref>{{Harvnb|Cole|2004|loc=2.1}}, {{Harvnb|Leibniz|1714|loc=section 17}}</ref> Лейбніцю було важко уявити, що «розум», здатний до «сприйняття», може бути побудований з використанням тільки механічних процесів. У короткому оповіданні 1961 року «Гра» [[Анатолій Дніпров|Анатолія Дніпрова]] стадіон людей виступає перемикачами та осередками пам'яті, які реалізують програму перекладу фрази португальської мови, яку ніхто з них не знає.<ref>{{Cite web | url=http://www.hardproblem.ru/en/posts/Events/a-russian-chinese-room-story-antedating-searle-s-1980-discussion/ | title=A Russian Chinese Room story antedating Searle's 1980 discussion}}</ref> У 1974 році Лоуренс Девіс уявляв собі дублювання мозку за допомогою телефонних ліній і офісів, у яких працювали люди, і в 1978 році Нед Блок передбачив, що все населення Китаю бере участь у такому моделюванні мозку. Цей розумовий експеримент називається Китайський мозок, також "китайська нація" або "китайський тренажерний зал".<ref>{{Harvnb|Cole|2004|loc=2.3}}</ref> |

||

Аргумент китайської кімнати був введений в 1980 році в документі Серля "Minds, Brains, and Programs" ("Розум, мозок і програми"), опублікований в журналі ''{{нп|Behavioral and Brain Sciences|Behavioral and Brain Sciences|en|Behavioral_and_Brain_Sciences}}''. У підсумку вона стала "найвпливовішою цільовою статтею" журналу, яка генерувала величезну кількість коментарів і відповідей у наступні десятиліття, і Серль продовжував захищати і уточнювати аргумент у багатьох статтях і книгах. Девід Коул пише, що "аргумент китайської кімнати, ймовірно, був найбільш широко обговорюваним філософським аргументом у когнітивній науці, який з'явився за останні 25 років". |

Аргумент китайської кімнати був введений в 1980 році в документі Серля "Minds, Brains, and Programs" ("Розум, мозок і програми"), опублікований в журналі ''{{нп|Behavioral and Brain Sciences|Behavioral and Brain Sciences|en|Behavioral_and_Brain_Sciences}}''.{{sfn|Searle|1980}} У підсумку вона стала "найвпливовішою цільовою статтею" журналу,{{sfn|Harnad|2001|p=1}} яка генерувала величезну кількість коментарів і відповідей у наступні десятиліття, і Серль продовжував захищати і уточнювати аргумент у багатьох статтях і книгах. Девід Коул пише, що "аргумент китайської кімнати, ймовірно, був найбільш широко обговорюваним філософським аргументом у когнітивній науці, який з'явився за останні 25 років".<ref>{{harvnb|Cole|2004|p=2}}; {{harvnb|Preston|Bishop|2002}}</ref> |

||

Більшість дискусій складається зі спроб спростування аргументу. "Переважна більшість, - відзначає редактор BBS Стеван Харнад, - як і раніше думає, що китайський аргумент кімнати мертвий". Об'єм літератури, що виріс навколо дискусії, надихнув Пата Хейса на коментар, що поле когнітивної науки має бути переосмислено як "триваюча дослідницька програма, яка показує, що аргумент китайської кімнати Серля є помилковим". |

Більшість дискусій складається зі спроб спростування аргументу. "Переважна більшість, - відзначає редактор BBS Стеван Харнад, - як і раніше думає, що китайський аргумент кімнати мертвий".{{sfn|Harnad|2001|p=2}} Об'єм літератури, що виріс навколо дискусії, надихнув Пата Хейса на коментар, що поле когнітивної науки має бути переосмислено як "триваюча дослідницька програма, яка показує, що аргумент китайської кімнати Серля є помилковим".<ref>{{harvnb|Harnad|2001|p=1}}; {{harvnb|Cole|2004|p=2}}</ref> |

||

Аргумент Серля став "чимось класичним у когнітивній науці", стверджує Харнад. Варол Акман погодився і охарактеризував оригінальну статтю як «зразок філософської чіткості і чистоти». |

|||

Аргумент Серля став "чимось класичним у когнітивній науці", стверджує Харнад. Варол Акман погодився і охарактеризував оригінальну статтю як «зразок філософської чіткості і чистоти».<ref>{{cite web |author-link=Varol Akman |last=Akman |first=Varol |year=1998 |title=Book Review — ''John Haugeland (editor), Mind Design II: Philosophy, Psychology, and Artificial Intelligence'' [Journal (Paginated)] |url=http://cogprints.org/539/index.html |access-date=2018-10-02 |via=Cogprints}}</ref> |

|||

== Філософія == |

== Філософія == |

||

| Рядок 34: | Рядок 36: | ||

{{Цитата|Належним чином запрограмований комп'ютер з правильними входами і виходами, таким чином, матиме розум в точно такому ж сенсі, як люди мають розум.}} |

{{Цитата|Належним чином запрограмований комп'ютер з правильними входами і виходами, таким чином, матиме розум в точно такому ж сенсі, як люди мають розум.}} |

||

Визначення залежить від відмінності між імітацією розуму та реальним розумом. Серль пише, що "згідно з Сильним ШІ, правильне моделювання дійсно є розумом. Згідно зі Слабким ШІ, правильне моделювання є моделлю розуму". |

Визначення залежить від відмінності між імітацією розуму та реальним розумом. Серль пише, що "згідно з Сильним ШІ, правильне моделювання дійсно є розумом. Згідно зі Слабким ШІ, правильне моделювання є моделлю розуму".{{sfn|Searle|2009|p=1}} |

||

Ця позиція випливає з деяких висловлювань дослідників та аналітиків раннього ШІ. Наприклад, у 1955 році засновник AI Герберт А. Саймон заявив, що "зараз у світі є машини, які думають, що навчаються і створюють" і стверджують, що вони "вирішили поважну проблему розуму і тіла", пояснюючи, як система, що складається з матерії, може володіти властивостями розуму. |

Ця позиція випливає з деяких висловлювань дослідників та аналітиків раннього ШІ. Наприклад, у 1955 році засновник AI [[Герберт Саймон|Герберт А. Саймон]] заявив,<ref>Quoted in {{Harvnb|Russell|Norvig|2003|p=21}}.</ref> що "зараз у світі є машини, які думають, що навчаються і створюють" і стверджують, що вони "вирішили поважну [[Дихотомія розуму та тіла|проблему розуму і тіла]]", пояснюючи, як система, що складається з матерії, може володіти властивостями розуму."<ref>Quoted in {{Harvnb|Crevier|1993|p=46}} and {{Harvnb|Russell|Norvig|2003|p=17}}.</ref> {{Не перекладено|Джон Хегленд||en|John_Haugeland}} писав, що "ШI хоче тільки справжню статтю: машини з розумом, в повному і буквальному сенсі. Це не наукова фантастика, а реальна наука, що ґрунтується на теоретичній концепції настільки глибокій, наскільки вона є сміливою, а саме, ми, насамперед, самі є комп'ютерами».{{sfn|Haugeland|1985|p=2|ps=(Italics his).}} |

||

Серль також приписує наступні позиції захисникам сильного ШІ: |

Серль також приписує наступні позиції захисникам сильного ШІ: |

||

| Рядок 42: | Рядок 44: | ||

*Системи штучного інтелекту можна використовувати для пояснення розуму; |

*Системи штучного інтелекту можна використовувати для пояснення розуму; |

||

*Вивчення мозку не має відношення до вивчення розуму; |

*Вивчення мозку не має відношення до вивчення розуму; |

||

*Тест |

*[[Тест Тюрінга|Тест Тьюрінга]] є достатнім для встановлення існування психічних станів. |

||

===Сильний ШІ, як комп'ютерна теорія розуму або функціоналізм=== |

===Сильний ШІ, як комп'ютерна теорія розуму або функціоналізм=== |

||

У більш пізніх презентаціях аргументу китайської кімнати, Серль визначив "сильний ШI" як "комп'ютерний функціоналізм" (термін він приписує Даніелю |

У більш пізніх презентаціях аргументу китайської кімнати, Серль визначив "сильний ШI" як "комп'ютерний {{Не перекладено|Функціоналізм (філософія розуму)|функціоналізм|en|Functionalism_(philosophy_of_mind)}}" (термін він приписує [[Деніел Деннет|Даніелю Деннетту]]).{{sfn|Searle|1992|p=44}}{{sfn|Searle|2004|p=45}} Функціоналізм - це позиція в сучасній [[Філософія свідомості|філософії свідомості]], яка передбачає, що ми можемо визначати психічні явища (такі як вірування, бажання і сприйняття), описуючи їхні функції по відношенню один до одного і до зовнішнього світу. Згідно з функціоналізмом, оскільки комп'ютерна програма може точно представляти функціональні відносини як відносини між символами, комп'ютер може мати психічні явища, якщо він виконує правильну програму. |

||

Стівен Харнад стверджує, що уявлення Серля про сильний ШI можна переформулювати як "впізнавані принципи обчислювальної діяльності, позиція (на відміну від "сильного ШI"), якої фактично дотримуються багато мислителів, і отже, ця позиція варта спростування. Комп'ютерна теорія розуму це позиція у філософії розуму, яка стверджує, що розум можна точно описати як систему обробки інформації. |

{{Не перекладено|Стівен Харнад||en|Stevan_Harnad}} стверджує, що уявлення Серля про сильний ШI можна переформулювати як "впізнавані принципи обчислювальної діяльності, позиція (на відміну від "сильного ШI"), якої фактично дотримуються багато мислителів, і отже, ця позиція варта спростування.{{sfn|Harnad|2001|loc=p. 3 (Italics his)}} [[Комп'ютерна теорія розуму]] це позиція у філософії розуму, яка стверджує, що розум можна точно описати як систему [[Обробка інформації|обробки інформації]]. |

||

Кожен з наступних пунктів, на думку Харнада, є "принципом" комп'ютерної теорії розуму: |

Кожен з наступних пунктів, на думку Харнада, є "принципом" комп'ютерної теорії розуму:{{sfn|Harnad|2001|pp=3–5}} |

||

*Психічні стани є обчислювальними станами (тому комп'ютери можуть мати психічні стани і допомагати пояснити розум); |

*Психічні стани є обчислювальними станами (тому комп'ютери можуть мати психічні стани і допомагати пояснити розум); |

||

*Обчислювальні стани є |

*Обчислювальні стани є {{Не перекладено|Множинна реалізація|незалежним від реалізації|en|Multiple_realizability}} - інакше кажучи, саме програмне забезпечення визначає обчислювальний стан, а не апаратні засоби (тому мозок, будучи апаратним, не має значення); |

||

*Оскільки реалізація не має значення, єдині емпіричні дані, які мають значення, це як функціонує система; отже, тест |

*Оскільки реалізація не має значення, єдині емпіричні дані, які мають значення, це як функціонує система; отже, [[Тест Тюрінга|тест Тьюрінга]] є остаточним. |

||

===Сильний ШІ проти біологічного натуралізму=== |

===Сильний ШІ проти біологічного натуралізму=== |

||

Серль займає філософську позицію, яку він називає «біологічним натуралізмом»: свідомість і розуміння вимагають особливого біологічного механізму, який міститься в мозку. Він пише «мозок викликає думку» і що «фактичні людські психічні явища залежать від реальних фізико-хімічних властивостей реальних людських мізків». Серль стверджує, що цей механізм (відомий нейронауці як "нейронні кореляти свідомості") повинен мати деякі (невизначені) "причинні сили", які дозволяють людському досвіду бути свідомостю. Віра Серля в існування цих повноважень була піддана критиці. |

Серль займає філософську позицію, яку він називає «{{Не перекладено|Біологічний натуралізм|біологічним натуралізмом|en|Biological_naturalism}}»: [[свідомість]] і [[Інтенціональність|розуміння]] вимагають особливого біологічного механізму, який міститься в мозку. Він пише «мозок викликає думку»{{sfn|Searle|1980|p=11}} і що «фактичні людські психічні явища залежать від реальних фізико-хімічних властивостей реальних людських мізків».{{sfn|Searle|1990|p=29}} Серль стверджує, що цей механізм (відомий [[Нейронаука|нейронауці]] як "{{Не перекладено|Нейронні кореляти свідомості|нейронні кореляти свідомості|en|Neural_correlates_of_consciousness}}") повинен мати деякі (невизначені) "причинні сили", які дозволяють людському досвіду бути свідомостю.{{sfn|Searle|1990}} Віра Серля в існування цих повноважень була піддана критиці. |

||

Серль погоджується з тим, що машини можуть мати свідомість і розуміння, тому що, як він пише, «ми є саме такими машинами». Серль вважає, що мозок, по суті, є машиною, але він дає початок свідомості і розуміння, використовуючи механізми, які не є обчислювальними. Якщо неврологія здатна ізолювати механічний процес, який породжує свідомість, то Серль надає можливість створити машини, які мають свідомість і розуміння. Однак, без специфічної техніки, Серль не вірить, що свідомість можна відтворити. |

Серль погоджується з тим, що машини можуть мати свідомість і розуміння, тому що, як він пише, «ми є саме такими машинами».{{sfn|Searle|1980|p=11}} Серль вважає, що мозок, по суті, є машиною, але він дає початок свідомості і розуміння, використовуючи механізми, які не є обчислювальними. Якщо неврологія здатна ізолювати механічний процес, який породжує свідомість, то Серль надає можливість створити машини, які мають свідомість і розуміння. Однак, без специфічної техніки, Серль не вірить, що свідомість можна відтворити. |

||

Біологічний натуралізм передбачає, що неможливо визначити, чи можна створити свідомість лише шляхом вивчення того, як функціонує система, оскільки особлива техніка головного мозку є суттєвою. Таким чином, біологічний натуралізм прямо протистоїть як [[Біхевіоризм|біхевіоризму]], так і [[Функціоналізм|функціоналізму]] (включаючи «комп'ютерний функціоналізм» або «сильний ШІ»).{{sfn|Hauser|2006|p=8}} Біологічний натуралізм подібний до теорії ідентичності (положення, що психічні стани "ідентичні" або "складаються з" неврологічних подій); однак, Серль має специфічні технічні заперечення проти теорії тотожності.{{sfn|Searle|1992|loc=chpt. 5}} Біологічний натуралізм Серля і сильний ШІ протиставляються декартовому дуалізму, класичній ідеї про те, що мозок і розум складаються з різних "речовин". Дійсно, Серль звинувачує сильний ШI в дуалізмі,{{sfn|Hauser|2006|p=8}} пишучи, що «сильний ШI має сенс лише з огляду на дуалістичне припущення, що там, де розум стурбований, мозок не має значення».{{sfn|Searle|1980|p=13}} |

|||

Біологічний натуралізм передбачає, що неможливо визначити, чи можна створити свідомість лише шляхом вивчення того, як функціонує система, оскільки особлива техніка головного мозку є суттєвою. Таким чином, біологічний натуралізм прямо протистоїть як біхевіоризму, так і функціоналізму (включаючи «комп'ютерний функціоналізм» або «сильний ШІ»). Біологічний натуралізм подібний до теорії ідентичності (положення, що психічні стани "ідентичні" або "складаються з" неврологічних подій); однак, Серль має специфічні технічні заперечення проти теорії тотожності. Біологічний натуралізм Серля і сильний ШІ протиставляються декартовому дуалізму, класичній ідеї про те, що мозок і розум складаються з різних "речовин". Дійсно, Серль звинувачує сильний ШI в дуалізмі, пишучи, що «сильний ШI має сенс лише з огляду на дуалістичне припущення, що там, де розум стурбований, мозок не має значення». |

|||

===Свідомість=== |

===Свідомість=== |

||

Оригінальна презентація Серля підкреслювала «розуміння» - тобто, психічні стани, які філософи називають «інтенціональністю», і безпосередньо не зверталися до інших тісно пов'язаних ідей, таких як «свідомість». Однак у більш пізніх презентаціях Серль включив свідомість як справжню мету аргументу. |

Оригінальна презентація Серля підкреслювала «розуміння» - тобто, психічні стани, які філософи називають «<nowiki/>[[Інтенціональність|інтенціональністю]]<nowiki/>», і безпосередньо не зверталися до інших тісно пов'язаних ідей, таких як «свідомість». Однак у більш пізніх презентаціях Серль включив свідомість як справжню мету аргументу.{{sfn|Searle|1992|p=44}} |

||

{{Цитата|автор=Джон Р. Серль|Моделі комп'ютерної теорії розуму самі по собі недостатні для свідомості. Комп'ютерна теорія розуму ґрунтується на свідомості так само, як обчислювальна модель чого-небудь ґрунтується на модельованому домені. Ніхто не припускає, що обчислювальна модель дощів у Лондоні залишить нас мокрими. Але вони роблять помилку, вважаючи, що комп'ютерна теорія розуму має якусь свідомість. Це одна й та ж помилка в обох випадках.|3=|4=Свідомість і мова, с. 16}} |

{{Цитата|автор=Джон Р. Серль|Моделі комп'ютерної теорії розуму самі по собі недостатні для свідомості. Комп'ютерна теорія розуму ґрунтується на свідомості так само, як обчислювальна модель чого-небудь ґрунтується на модельованому домені. Ніхто не припускає, що обчислювальна модель дощів у Лондоні залишить нас мокрими. Але вони роблять помилку, вважаючи, що комп'ютерна теорія розуму має якусь свідомість. Це одна й та ж помилка в обох випадках.|3=|4=Свідомість і мова, с. 16}} |

||

Девід Чалмерс пише: "цілком зрозуміло, що свідомість знаходиться в корені питання" китайської кімнати. |

[[Девід Чалмерс]] пише: "цілком зрозуміло, що свідомість знаходиться в корені питання" китайської кімнати.{{sfn|Chalmers|1996|p=322}} |

||

Колін Макгінн стверджує, що китайська кімната надає вагомі докази того, що важка проблема свідомості є принципово нерозв'язною. Аргумент, щоб бути зрозумілим, полягає не в тому, чи може машина бути свідомою, а в тому, чи може він (або що-небудь інше) бути свідомим. Зрозуміло, що будь-який інший метод перевірки окупанта китайської кімнати має такі ж принципові труднощі, як обмін питаннями і відповідями на китайській мові. Це просто неможливо визначити, чи є у приміщенні хтось свідомий або якесь розумне моделювання. |

Колін Макгінн стверджує, що китайська кімната надає вагомі докази того, що [[важка проблема свідомості]] є принципово нерозв'язною. Аргумент, щоб бути зрозумілим, полягає не в тому, чи може машина бути свідомою, а в тому, чи може він (або що-небудь інше) бути свідомим. Зрозуміло, що будь-який інший метод перевірки окупанта китайської кімнати має такі ж принципові труднощі, як обмін питаннями і відповідями на китайській мові. Це просто неможливо визначити, чи є у приміщенні хтось свідомий або якесь розумне моделювання.{{sfn|McGinn|2000}} |

||

Серль стверджує, що це справедливо лише для спостерігача поза кімнатою. Вся думка експерименту полягає в тому, щоб помістити людину всередину кімнати, де вони можуть безпосередньо спостерігати за операціями свідомості. Серль стверджує, що з його точки зору в кімнаті немає нічого, що, на його погляд, могло бути свідомістю, крім себе, і явно не має розуму, який може говорити по-китайськи. |

Серль стверджує, що це справедливо лише для спостерігача поза кімнатою. Вся думка експерименту полягає в тому, щоб помістити людину всередину кімнати, де вони можуть безпосередньо спостерігати за операціями свідомості. Серль стверджує, що з його точки зору в кімнаті немає нічого, що, на його погляд, могло бути свідомістю, крім себе, і явно не має розуму, який може говорити по-китайськи. |

||

| Рядок 78: | Рядок 81: | ||

===Прикладна етика=== |

===Прикладна етика=== |

||

Патрік Хью використовував аргумент китайської кімнати, щоб вивести вимоги від військових систем управління і командування, якщо вони хочуть зберегти моральне керівництво командира. Він провів аналогію між командувачем у їхньому командному центрі і людиною в китайській кімнаті і проаналізував її читаючи поняття Арістотеля про "обов'язки" і "незнання". Інформація може бути "перетворена" з сенсу в символи і маніпулюватися символічно, але моральне втручання могло бути підірване, якщо було неадекватне "перетворення" в сенс. Хью цитував приклади інциденту USS Vincennes. |

Патрік Хью використовував аргумент китайської кімнати, щоб вивести вимоги від військових систем [[Управління військами|управління і командування]], якщо вони хочуть зберегти моральне керівництво командира. Він провів аналогію між командувачем у їхньому командному центрі і людиною в китайській кімнаті і проаналізував її читаючи [[Нікомахова етика|поняття Арістотеля про "обов'язки" і "незнання"]]. Інформація може бути "перетворена" з сенсу в символи і маніпулюватися символічно, але моральне втручання могло бути підірване, якщо було неадекватне "перетворення" в сенс. Хью цитував приклади інциденту USS Vincennes.<ref>{{cite journal |last1=Hew|first1=Patrick Chisan|title=Preserving a combat commander's moral agency: The Vincennes Incident as a Chinese Room|journal=Ethics and Information Technology|date=September 2016|volume=18|issue=3|pages=227–235 |doi=10.1007/s10676-016-9408-y}}</ref> |

||

==Інформатика== |

==Інформатика== |

||

Аргумент китайської кімнати - це, перш за все, аргумент у філософії |

Аргумент китайської кімнати - це, перш за все, аргумент у [[Філософія свідомості|філософії свідомості]], і як головні дослідники у сфері інформатики, так і дослідники штучного інтелекту вважають це незначним для їхніх галузей.{{sfn|Russell|Norvig|2003|p=947}} Однак, кілька концепцій, розроблених вченими у сфері інформатики, мають важливе значення для розуміння аргументу, включаючи [[Гіпотеза Ньюела-Саймона|обробку символів]], [[Машина Тюрінга|машини Тьюрінга]], [[Повнота за Тюрингом|повноту Тьюрінга]] і [[Тест Тюрінга|тест Тьюрінга]]. |

||

===Сильний ШІ проти дослідження ШІ=== |

===Сильний ШІ проти дослідження ШІ=== |

||

Аргументи Серля зазвичай не розглядаються як питання для дослідження ШІ. Стюарт Рассел і Пітер Норвіг зауважують, що більшість дослідників інтелектуальної власності "не піклуються про сильну гіпотезу ШІ - до тих пір, поки програма працює, їм не важливо, чи називаєте ви це імітацією інтелекту або реальним інтелектом". Основна місія дослідження штучного інтелекту полягає лише в тому, щоб створити корисні системи, які діють розумно, і це не має значення, якщо інтелект є «просто» імітацією. |

Аргументи Серля зазвичай не розглядаються як питання для дослідження ШІ. Стюарт Рассел і [[Пітер Норвіг]] зауважують, що більшість дослідників інтелектуальної власності "не піклуються про сильну гіпотезу ШІ - до тих пір, поки програма працює, їм не важливо, чи називаєте ви це імітацією інтелекту або реальним інтелектом".{{sfn|Russell|Norvig|2003|p=947}} Основна місія дослідження [[Штучний інтелект|штучного інтелекту]] полягає лише в тому, щоб створити корисні системи, які діють розумно, і це не має значення, якщо інтелект є «просто» імітацією. |

||

Серль не погоджується з тим, що дослідження ШІ можуть створювати машини, здатні до високоінтелектуальної поведінки. Аргумент китайської кімнати залишає відкритою можливість того, що може бути побудована цифрова машина, яка діє більш розумно, ніж людина, але не має розуму або інтенціональності так само, як це робить мозок. Аргумент китайської кімнати не є доведеним до абсурду, а є прикладом, який вимагає пояснення. |

Серль не погоджується з тим, що дослідження ШІ можуть створювати машини, здатні до високоінтелектуальної поведінки. Аргумент китайської кімнати залишає відкритою можливість того, що може бути побудована цифрова машина, яка діє більш розумно, ніж людина, але не має [[Розум|розуму]] або [[Інтенціональність|інтенціональності]] так само, як це робить [[Головний мозок людини|мозок]]. Аргумент китайської кімнати не є [[Доведення до абсурду|доведеним до абсурду]], а є прикладом, який вимагає пояснення. |

||

"Сильний ШІ" Серля не слід плутати із "сильним ШІ", як це визначено Реймондом |

"Сильний ШІ" Серля не слід плутати із "[[Сильний штучний інтелект|сильним ШІ]]", як це визначено [[Реймонд Курцвейл|Реймондом Курцвейлом]] та іншими футуристами,{{sfn|Kurzweil|2005|p=260}} які використовують цей термін для опису машинного розуму, який конкурує або перевершує людський інтелект. Курцвейл спирається, головним чином, на кількість інтелекту, що відображається машиною, тоді як аргумент Серля не обмежує цього. Серль стверджує, що навіть супер-розумна машина не обов'язково має розум і свідомість. |

||

===Тест |

===Тест Тьюрінга=== |

||

{{main article|Тест Тьюрінга}} |

|||

[[File:Turing Test version 3.png|thumb|"Стандартна інтерпретація" тесту Тьюрінга, в якій гравець C, опитувальник, має завдання спробувати визначити, який гравець - A або B - це комп'ютер і який є людиною. Слідчий обмежується використанням відповідей на письмові запитання, щоб зробити визначення]] |

|||

Китайська кімната реалізує варіант [[Тест Тюрінга|тесту Тьюрінга]].{{sfn|Turing|1950}} [[Алан Тюрінг|Алан Тьюрінг]] ввів тест в 1950 році, щоб допомогти відповісти на питання «чи може машина мислити?» У стандартній версії, людина-суддя бере участь в розмові на природній мові з людиною і машиною, призначеної для генерації продуктивності неотличимой від людських істот. Всі учасники розділені один від одного. Якщо суддя не може надійно відрізнити машину від людини, машина, як кажуть, пройшла тест. |

|||

Тьюрінг потім розглянув кожні з можливих заперечень проти пропозиції «машини можуть думати», і виявив, що є прості, очевидні відповіді, якщо питання де-спантеличені таким чином. Він, однак, не призначається для випробування вимірювання наявності «свідомості» або «розуміння». Він не вірив, що це ставлення до проблем, з якою він звертався. Він писав: |

|||

Китайська кімната реалізує варіант тесту Тьюринга. Алан Тьюринг ввів тест в 1950 році, щоб допомогти відповісти на питання «чи може машина мислити?» У стандартній версії, людина-суддя бере участь в розмові на природній мові з людиною і машиною, призначеної для генерації продуктивності неотличимой від людських істот. Всі учасники розділені один від одного. Якщо суддя не може надійно відрізнити машину від людини, машина, як кажуть, пройшла тест. |

|||

Тьюринг потім розглянув кожні з можливих заперечень проти пропозиції «машини можуть думати», і виявив, що є прості, очевидні відповіді, якщо питання де-спантеличені таким чином. Він, однак, не призначається для випробування вимірювання наявності «свідомості» або «розуміння». Він не вірив, що це ставлення до проблем, з якою він звертався. Він писав: |

|||

{{Цитата|Я не хочу створити враження, що я думаю, що немає ніякої таємниці свідомості. Існує, наприклад, щось схоже на парадокс, пов'язаний з будь-якими спробами локалізувати його. Але я не думаю, що ці таємниці обов'язково повинні бути вирішені перш, ніж ми можемо відповісти на питання, які турбують нас в цій статті.}} |

{{Цитата|Я не хочу створити враження, що я думаю, що немає ніякої таємниці свідомості. Існує, наприклад, щось схоже на парадокс, пов'язаний з будь-якими спробами локалізувати його. Але я не думаю, що ці таємниці обов'язково повинні бути вирішені перш, ніж ми можемо відповісти на питання, які турбують нас в цій статті.}} |

||

Для Серля, як філософа, який працює в галузі розуму і свідомості, це відповідні таємниці. Китайська кімната призначена, щоб показати, що тест |

Для Серля, як філософа, який працює в галузі розуму і свідомості, це відповідні таємниці. Китайська кімната призначена, щоб показати, що тест Тьюрінга є недостатнім для виявлення присутності свідомості, навіть якщо в кімнаті може бути машина, що [[Функціоналізм|функціонує]] як свідомий розум. |

||

===Обробка символів=== |

===Обробка символів=== |

||

{{Main article|Гіпотеза Ньюела-Саймона}} |

|||

Китайська кімната (і всі сучасні комп'ютери) маніпулює фізичними об'єкти для того, щоб проводити розрахунки і робити моделювання. Дослідники штучного інтелекту [[Аллен Ньюел|Аллен Ньюелл]] і [[Герберт Саймон|Герберт А. Саймон]] назвали це свого роду машиною, [[Гіпотеза Ньюела-Саймона|фізичною системою символів]]. Це еквівалентно також [[Формальна система|формальним системам]], використовуваних в галузі [[Математична логіка|математичної логіки]]. |

|||

Серль підкреслює той факт, що подібного роду маніпуляції символами є [[Синтаксис|синтаксичними]] (запозичуючи термін з вивчення [[Граматика|граматики]]). Комп'ютер маніпулює символами, використовуючи форму [[Синтаксис|синтаксичних правил]], без яких-небудь знань про [[Семантика|семантику]] символів (тобто їх зміст). |

|||

Китайська кімната (і всі сучасні комп'ютери) маніпулює фізичними об'єкти для того, щоб проводити розрахунки і робити моделювання. Дослідники штучного інтелекту Аллен Ньюелл і Герберт А. Саймон назвали це свого роду машиною, фізичною системою символів. Це еквівалентно також формальним системам, використовуваних в галузі математичної логіки. |

|||

Ньюелл і Саймон припустив, що фізична система символів (наприклад, цифровий комп'ютер) мав все необхідне обладнання для «загальної інтелектуальної дії», або, як це відомо сьогодні, [[Сильний штучний інтелект|загальний штучний інтелект]]. Вони описали це як філософську позиція, [[Гіпотеза Ньюела-Саймона|гіпотези фізичної системи символів]]: «Фізична система символу має [[Необхідна і достатня умова|необхідні і достатні умови]] для загальнї інтелектуальної дії».{{sfn|Newell|Simon|1976|p=116}}{{sfn|Russell|Norvig|2003|p=18}} Аргумент китайської кімнати не спростовує це, тому що він оформлений з точки зору «розумних дій», тобто зовнішня поведінка машини, а не наявність або відсутність розуміння свідомості і розуму. |

|||

Серль підкреслює той факт, що подібного роду маніпуляції символами є синтаксичними (запозичуючи термін з вивчення граматики). Комп'ютер маніпулює символами, використовуючи форму синтаксичних правил, без яких-небудь знань про семантику символів (тобто їх зміст). |

|||

===Китайська кімната та Тьюрінгова повнота=== |

|||

Ньюелл і Саймон припустив, що фізична система символів (наприклад, цифровий комп'ютер) мав все необхідне обладнання для «загальної інтелектуальної дії», або, як це відомо сьогодні, загальний штучний інтелект. Вони описали це як філософську позиція, гіпотези фізичної системи символів: «Фізична система символу має необхідні і достатні кошти для загальнї інтелектуальної дії». Аргумент китайської кімнати не спростовує це, тому що він оформлений з точки зору «розумних дій», тобто зовнішня поведінка машини, а не наявність або відсутність розуміння свідомості і розуму. |

|||

{{See also|Повнота за Тюрингом|Теза Черча — Тюрінга}} |

|||

Китайська кімната має конструкцію, аналогічну сучасному комп'ютеру. Вона має [[Архітектура фон Неймана|архітектуру фон Неймана]], яка складається з програми (книг інструкцій), деяка кількість пам'яті (паперу і картотека), [[Центральний процесор|процесор]], який слідує інструкціям (людина), і засіб для запису символів в пам'яті (олівець і ластик). Машина цієї конструкції відома в області [[Теоретична інформатика|теоретичної інформатики]] як «<nowiki/>[[Машина Тюрінга|Тьюрінгова]]<nowiki/>», тому що вона має необхідний механізм для виконання будь-яких обчислень, що [[Машина Тюрінга|машина Тьюрінга]] може зробити, і, отже, вона здатна робити крок за кроком моделювання будь-якого іншого цифрового апарату, враховуючи достатню кількість пам'яті і часу. [[Алан Тюрінг|Алан Тьюрінг]] пише: «всі цифрові комп'ютери в певному сенсі еквівалентні." Широко прийнята [[Теза Черча — Тюрінга|Теза Черча-Тьюрінга]] стверджує, що будь-яка функція обчислюється за допомогою ефективної процедури обчислення на машині Тьюрінга. |

|||

Тьюрінгова повнота китайської кімнаті означає, що вона може робити все, що будь-який інший цифровий комп'ютер може зробити (хоча і набагато, набагато повільніше). Таким чином, якщо китайська кімната не містить чи не може містити китайськомовного розуму, то ніякий інший цифровий комп'ютер не може містити розум. Деякі відповіді Серль починає, стверджуючи, що в кімнаті, як описано вище, може не бути китайськомовного розуму. Аргументи цієї форми, відповідно до Стівена Харнада, є «не спростуванням (а швидше твердженням)»{{sfn|Harnad|2001|p=14}} аргументу китайської кімнати, тому що ці аргументи фактично означають, що ніякі цифрові комп'ютери не можуть мати розум.{{sfn|Harnad|2001}} |

|||

===Китайська кімната та Тьюрингова повнота=== |

|||

Китайська кімната має конструкцію, аналогічну сучасному комп'ютеру. Вона має архітектуру фон Неймана, яка складається з програми (книг інструкцій), деяка кількість пам'яті (паперу і картотека), процесор, який слідує інструкціям (людина), і засіб для запису символів в пам'яті (олівець і ластик). Машина цієї конструкції відома в області теоретичної інформатики як «Тьюрингова», тому що вона має необхідний механізм для виконання будь-яких обчислень, що машина Тьюринга може зробити, і, отже, вона здатна робити крок за кроком моделювання будь-якого іншого цифрового апарату, враховуючи достатню кількість пам'яті і часу. Алан Тьюринг пише: «всі цифрові комп'ютери в певному сенсі еквівалентні." Широко прийнята Теза Черча-Тьюринга стверджує, що будь-яка функція обчислюється за допомогою ефективної процедури обчислення на машині Тьюринга. |

|||

Є деякі критики, такі як Енох Бен-Ямі, які стверджують, що китайська кімната не може навіть емітувати всі можливості цифрового комп'ютера, наприклад, не маючи змоги визначити поточний час.{{sfn|Ben-Yami|1993}} |

|||

Тьюрингова повнота китайської кімнаті означає, що вона може робити все, що будь-який інший цифровий комп'ютер може зробити (хоча і набагато, набагато повільніше). Таким чином, якщо китайська кімната не містить чи не може містити китайськомовного розуму, то ніякий інший цифровий комп'ютер не може містити розум. Деякі відповіді Серль починає, стверджуючи, що в кімнаті, як описано вище, може не бути китайськомовного розуму. Аргументи цієї форми, відповідно до Стівена Харнада, є «не спростуванням (а швидше твердженням)» аргументу китайської кімнати, тому що ці аргументи фактично означають, що ніякі цифрові комп'ютери не можуть мати розум. |

|||

Є деякі критики, такі як Енох Бен-Ямі, які стверджують, що китайська кімната не може навіть емітувати всі можливості цифрового комп'ютера, наприклад, не маючи змоги визначити поточний час. |

|||

== Формалізація == |

== Формалізація == |

||

[[Джон Серль]] випустив більш формальний варіант аргументу, частиною якого є китайська кімната. Першу версію він представив у 1984 році. Версія, наведена нижче, починається з 1990 року. |

[[Джон Серль]] випустив більш формальний варіант аргументу, частиною якого є китайська кімната. Першу версію він представив у 1984 році. Версія, наведена нижче, починається з 1990 року.<ref>{{Harvnb|Searle|1984}}; {{Harvnb|Searle|1990}}.</ref> |

||

:(A1) "Програми є формальними (синтаксичними)." |

:(A1) "Програми є формальними ([[Синтаксис|синтаксичними]])." |

||

::Програма використовує синтаксис для керування символами і не звертає уваги на семантику символів. Вона знає, куди покласти символи і як їх перемістити, але вона не знає, нащо вони потрібні або що вони означають. Для програми символи - це тільки фізичні об'єкти, як і будь-які інші. |

::Програма використовує [[синтаксис]] для керування символами і не звертає уваги на [[Семантика|семантику]] символів. Вона знає, куди покласти символи і як їх перемістити, але вона не знає, нащо вони потрібні або що вони означають. Для програми символи - це тільки фізичні об'єкти, як і будь-які інші. |

||

:(A2) "Розуми мають розумовий зміст (семантика)". |

:(A2) "Розуми мають розумовий зміст ([[семантика]])". |

||

::На відміну від символів, що використовуються програмою, наші думки мають сенс: вони представляють речі, і ми знаємо, що вони представляють. |

::На відміну від символів, що використовуються програмою, наші думки мають сенс: вони представляють речі, і ми знаємо, що вони представляють. |

||

:(A3) "Синтаксис сам по собі не є ні конститутивним, ні достатнім для семантики". |

:(A3) "Синтаксис сам по собі не є ні конститутивним, ні достатнім для семантики". |

||

| Рядок 132: | Рядок 137: | ||

::Це має бути вірним без розбіжностей з першими трьома аксіомами: програми не мають семантики. Програми мають тільки синтаксис, а синтаксис недостатній для семантики. Кожен розум має семантику. Тому ніякі програми не є свідомістю. |

::Це має бути вірним без розбіжностей з першими трьома аксіомами: програми не мають семантики. Програми мають тільки синтаксис, а синтаксис недостатній для семантики. Кожен розум має семантику. Тому ніякі програми не є свідомістю. |

||

Такий аргумент має на меті показати, що штучний інтелект ніколи не може створити машину з розумом, написавши програми, які маніпулюють символами. Решта аргументів стосуються іншого питання. Чи працює людський мозок? Іншими словами, чи є обчислювальна теорія розуму правильною? Він починає з аксіоми, яка покликана висловити основний сучасний науковий консенсус про мозок і розум: |

Такий аргумент має на меті показати, що [[штучний інтелект]] ніколи не може створити машину з розумом, написавши програми, які маніпулюють символами. Решта аргументів стосуються іншого питання. Чи працює людський мозок? Іншими словами, чи є [[Комп'ютерна теорія розуму|обчислювальна теорія розуму]] правильною? Він починає з аксіоми, яка покликана висловити основний сучасний науковий консенсус про мозок і розум: |

||

:(A4) [[Головний мозок|Мозок]] породжує розум. |

:(A4) [[Головний мозок|Мозок]] породжує розум. |

||

::Серль стверджує, що ми можемо "негайно" і "тривіально" вивести те, що |

::Серль стверджує, що ми можемо "негайно" і "тривіально"{{sfn|Searle|1990}} вивести те, що |

||

:(С2) Будь-яка інша система, здатна викликати розум, повинна мати причинну силу (принаймні), еквівалентну мозковим. |

:(С2) Будь-яка інша система, здатна викликати розум, повинна мати причинну силу (принаймні), еквівалентну мозковим. |

||

| Рядок 153: | Рядок 158: | ||

* На думку [[Станіслав Лем|Станіслава Лема]]<ref> Станіслав Лем, стаття [http://alt-future.narod.ru/Lem/Tkk/tkk.htm «Таємниця китайської кімнати»] (Лем С. " Молох ", М:. АСТ: Транзіткніга, 2005, с.246-255) </ref>, розуміння у самій "китайської кімнаті " дійсно '''не''' існує, але воно є в мозку її творця — того, хто розробив систему правил поводження з ієрогліфами для учасника експерименту. «Робота завжди асемантично формальна», і це не може бути підставою говорити про відсутність розуміння. Автор експерименту повинен був заздалегідь передбачити всі комбінації питань і відповідей або придумати принцип добору відповіді на запитання. У реальних умовах при створенні передбачуваного штучного інтелекту навряд чи таке буде можливо. |

* На думку [[Станіслав Лем|Станіслава Лема]]<ref> Станіслав Лем, стаття [http://alt-future.narod.ru/Lem/Tkk/tkk.htm «Таємниця китайської кімнати»] (Лем С. " Молох ", М:. АСТ: Транзіткніга, 2005, с.246-255) </ref>, розуміння у самій "китайської кімнаті " дійсно '''не''' існує, але воно є в мозку її творця — того, хто розробив систему правил поводження з ієрогліфами для учасника експерименту. «Робота завжди асемантично формальна», і це не може бути підставою говорити про відсутність розуміння. Автор експерименту повинен був заздалегідь передбачити всі комбінації питань і відповідей або придумати принцип добору відповіді на запитання. У реальних умовах при створенні передбачуваного штучного інтелекту навряд чи таке буде можливо. |

||

==Цитати== |

|||

{{reflist|20em}} |

|||

==Посилання== |

|||

{{refbegin}} |

|||

* {{cite journal |ref=harv |first=Mike |last=Alder |year=2004 |title=Newton's Flaming Laser Sword |url=http://www.philosophynow.org/issues/46/Newtons_Flaming_Laser_Sword |journal=[[Philosophy Now]] |volume=46 |issue= |pages=29–33 |doi= |dead-url=no |archive-url=https://web.archive.org/web/20180326114344/http://www.philosophynow.org/issues/46/Newtons_Flaming_Laser_Sword |archive-date=2018-03-26}} Also available at {{cite web |title=Newton's Flaming Laser Sword |url=http://school.maths.uwa.edu.au/~mike/Newtons%20Flaming%20Laser%20Sword.pdf |deadurl=yes |archiveurl=https://web.archive.org/web/20111114041242/http://school.maths.uwa.edu.au/~mike/Newtons%20Flaming%20Laser%20Sword.pdf |archivedate=14 November 2011 }} |

|||

* {{Citation |

|||

| last=Ben-Yami | first=Hanoch |

|||

| title=A Note on the Chinese Room |

|||

| year=1993 |

|||

| journal=Synthese | volume=95 | number=2 |

|||

| pages=169–72 |

|||

| doi=10.1007/bf01064586 |

|||

}} |

|||

* {{Citation |

|||

| last = Block | first = Ned | author-link = Ned Block |

|||

| year = 1981 |

|||

| title = Psychologism and Behaviourism |

|||

| journal = The Philosophical Review | volume=90 | issue=1 |

|||

| pages = 5–43 |

|||

| doi = 10.2307/2184371 | jstor = 2184371 |

|||

| url = http://www.nyu.edu/gsas/dept/philo/faculty/block/papers/Psychologism.htm |

|||

| citeseerx = 10.1.1.4.5828 }} |

|||

* {{Citation |

|||

| last=Chalmers | first=David | author-link=David Chalmers |

|||

| title=The Conscious Mind: In Search of a Fundamental Theory |

|||

| publisher=Oxford University Press |

|||

|url={{google books |plainurl=y |id=XtgiH-feUyIC}}|date=30 March 1996 |

|||

|isbn=978-0-19-983935-3}} |

|||

* {{Citation |

|||

| last=Churchland | first=Paul | last2=Churchland |

|||

| first2=Patricia | author-link=Paul Churchland | author2-link = Patricia Churchland |

|||

| title= Could a machine think? |

|||

| journal=Scientific American | volume=262 | issue=1 |

|||

| date = January 1990 |

|||

| pages=32–39 |

|||

| pmid = 2294584 | doi=10.1038/scientificamerican0190-32 |

|||

| bibcode=1990SciAm.262a..32C}} |

|||

* {{Citation |

|||

| last=Cole | first=David <!-- no article yet for this David Cole --> |

|||

| contribution =The Chinese Room Argument |

|||

| title= The Stanford Encyclopedia of Philosophy |

|||

| date = Fall 2004 |

|||

| editor-first = Edward N. | editor-last = Zalta |

|||

| url=http://plato.stanford.edu/archives/fall2004/entries/chinese-room/ }} |

|||

*: ''Page numbers above refer to a standard [[pdf]] print of the article.'' |

|||

* {{Crevier 1993}} |

|||

* {{Citation |

|||

| last=Dennett | first=Daniel | author-link=Daniel Dennett |

|||

| year=1991 |

|||

| title=Consciousness Explained |

|||

| publisher=The Penguin Press |

|||

| isbn= 978-0-7139-9037-9 |

|||

| title-link=Consciousness Explained }} |

|||

* {{Citation |

|||

| last=Dreyfus | first=Hubert | authorlink = Hubert Dreyfus |

|||

| year =1979 |

|||

| title = What Computers ''Still'' Can't Do |

|||

| publisher = MIT Press | location = New York |

|||

| isbn=978-0-262-04134-8 |

|||

}} |

|||

* {{Citation |

|||

| last=Fearn | first=Nicholas |

|||

| year =2007 |

|||

| title= The Latest Answers to the Oldest Questions: A Philosophical Adventure with the World's Greatest Thinkers |

|||

| publisher = Grove Press | location=New York |

|||

}} |

|||

* {{Citation |

|||

| last=Harnad | first=Stevan | author-link=Stevan Harnad |

|||

| year=2001 |

|||

| url=http://cogprints.org/4023/ |

|||

|contribution= What's Wrong and Right About Searle's Chinese Room Argument |editor-last= M. |

|||

|editor2-last=Preston|editor2-first= J. |

|||

|title=Views into the Chinese Room: New Essays on Searle and Artificial Intelligence |

|||

|publisher=Oxford University Press |

|||

}} |

|||

:''Page numbers above refer to a standard [[pdf]] print of the article.'' |

|||

* {{Citation |

|||

| last=Harnad | first=Stevan |

|||

| author-link=Stevan Harnad |

|||

| year=2005 |

|||

| url=http://eprints.ecs.soton.ac.uk/10424/01/chineseroom.html |

|||

|contribution= Searle's Chinese Room Argument |

|||

| title=Encyclopedia of Philosophy |

|||

|publisher= Macmillan}} |

|||

:''Page numbers above refer to a standard [[pdf]] print of the article.'' |

|||

* {{Citation |

|||

| last=Haugeland | first=John | author-link = John Haugeland |

|||

| year = 1985 |

|||

| title = Artificial Intelligence: The Very Idea |

|||

| publisher=MIT Press| location= Cambridge, Mass. |

|||

| isbn=978-0-262-08153-5 |

|||

}} |

|||

* {{Citation |

|||

| last=Haugeland | first=John | author-link = John Haugeland |

|||

| year = 1981 |

|||

| title = Mind Design |

|||

| publisher=MIT Press| location= Cambridge, Mass. |

|||

| isbn=978-0-262-08110-8 |

|||

}} |

|||

* {{Citation |

|||

| last=Hauser | first=Larry | author-link=Larry Hauser |

|||

| year=2006 |

|||

| contribution=Searle's Chinese Room |

|||

| title=Internet Encyclopedia of Philosophy |

|||

| url=http://www.iep.utm.edu/c/chineser.htm }} |

|||

:''Page numbers above refer to a standard [[pdf]] print of the article.'' |

|||

* {{Citation |

|||

| first = Ray | last = Kurzweil | author-link =Ray Kurzweil |

|||

| title = The Singularity is Near |

|||

| year = 2005 |

|||

| publisher = Viking Press |

|||

| title-link = The Singularity is Near }} |

|||

* {{Citation |

|||

| last=Horst | first= Steven |

|||

| contribution =The Computational Theory of Mind |

|||

| title= The Stanford Encyclopedia of Philosophy |

|||

| date = Fall 2005 |

|||

| editor-first = Edward N. | editor-last = Zalta |

|||

| url = http://plato.stanford.edu/archives/fall2005/entries/computational-mind/ |

|||

}} |

|||

* {{Citation|last=Leibniz |first=Gottfried |authorlink=Gottfried Leibniz |year=1714 |title=Monadology |others=George MacDonald Ross (trans.) |url=http://www.philosophy.leeds.ac.uk/GMR/moneth/monadology.html |dead-url=yes |archiveurl=https://web.archive.org/web/20110703072430/http://www.philosophy.leeds.ac.uk/GMR/moneth/monadology.html |archivedate=July 3, 2011 }} |

|||

* {{Citation |

|||

| first = Hans | last = Moravec | author-link =Hans Moravec |

|||

| year = 1988 |

|||

| publisher = Harvard University Press |

|||

|title=Mind Children: The Future of Robot and Human Intelligence |

|||

|url={{google books |plainurl=y |id=56mb7XuSx3QC}}}} |

|||

* {{Citation |

|||

| first = Marvin | last = Minsky | author-link = Marvin Minsky |

|||

| year = 1980 |

|||

| title = Decentralized Minds |

|||

| journal = [[Behavioral and Brain Sciences]] | volume = 3 | issue = 3 |

|||

| pages=439–40 |

|||

| doi=10.1017/S0140525X00005914 |

|||

}} |

|||

* {{Citation |

|||

| title=The Mysterious Flame: Conscious Minds In A Material World |

|||

| last=McGinn|first=Collin |

|||

| page=194 |

|||

| year=2000 |publisher=Basic Books |

|||

| isbn=978-0786725168 |

|||

| url={{google books |plainurl=y |id=qB0lg0u3BEkC|page=194}} |

|||

}} |

|||

* {{Citation |

|||

| editor-last=Moor | editor-first=James |

|||

| year=2003 |

|||

| title=The Turing Test: The Elusive Standard of Artificial Intelligence |

|||

| isbn=978-1-4020-1205-1 |

|||

| publisher=Kluwer Academic Publishers| location=Dordrecht |

|||

}} |

|||

* {{Citation |

|||

| last=Motzkin | first=Elhanan |

|||

| last2=Searle | first2=John | author2-link=John Searle |

|||

| date=February 16, 1989 |

|||

| title=Artificial Intelligence and the Chinese Room: An Exchange |

|||

| publisher=New York Review of Books |

|||

| url=http://www.nybooks.com/articles/archives/1989/feb/16/artificial-intelligence-and-the-chinese-room-an-ex/?pagination=false |

|||

}} |

|||

* {{Citation |

|||

| doi = 10.1145/360018.360022 |

|||

| last = Newell | first = Allen | author-link=Allen Newell |

|||

| last2 = Simon | first2=H. A. | authorlink2=Herbert A. Simon |

|||

| year = 1976 |

|||

| title=Computer Science as Empirical Inquiry: Symbols and Search |

|||

| volume= 19 | pages = 113–126 |

|||

| journal = Communications of the ACM |

|||

|issue=3 |

|||

}} |

|||

*{{Citation |

|||

| last = Nikolić | first = Danko |

|||

| year = 2015 |

|||

| title = Practopoiesis: Or how life fosters a mind |

|||

| journal = Journal of Theoretical Biology |

|||

| volume = 373 |

|||

| pages = 40–61 |

|||

| doi=10.1016/j.jtbi.2015.03.003 |

|||

| pmid=25791287 |

|||

| arxiv = 1402.5332 |

|||

}} |

|||

* {{Citation |

|||

| first = Nils | last = Nilsson | author-link = Nils Nilsson (researcher) |

|||

| url =http://ai.stanford.edu/%7Enilsson/OnlinePubs-Nils/General%20Essays/OtherEssays-Nils/searle.pdf |

|||

| title =A Short Rebuttal to Searle |

|||

| year = 1984 |

|||

}} |

|||

* {{Russell Norvig 2003}} |

|||

* {{Citation |

|||

| last=Pinker | first=Steven | author-link=Steven Pinker |

|||

| year=1997 |

|||

| title=How the Mind Works |

|||

| publisher=W. W. Norton & Company, Inc. | location=New York, NY |

|||

| isbn=978-0-393-31848-7 |

|||

| title-link=How the Mind Works }} |

|||

* {{Citation |

|||

| year=2002 |

|||

|editor-first=John | editor-last= Preston |

|||

|editor2-last=Bishop|editor2-first= Mark |

|||

|title=Views into the Chinese Room: New Essays on Searle and Artificial Intelligence |

|||

|publisher=Oxford University Press |

|||

| isbn= 978-0-19-825057-9 |

|||

|url={{google books |plainurl=y |id=N7msQgAACAAJ}}}} |

|||

* {{Citation |

|||

| first=A. P.| last=Saygin |first2=I.|last2=Cicekli|first3=V.|last3=Akman |

|||

| year=2000| ref={{harvid|Saygin|2000}} |

|||

| title=Turing Test: 50 Years Later |

|||

| journal=Minds and Machines|volume=10|issue=4|pages=463–518 |

|||

| url=http://crl.ucsd.edu/~saygin/papers/MMTT.pdf |

|||

| doi=10.1023/A:1011288000451 |

|||

}}. Reprinted in {{harvtxt|Moor|2003|pp=23–78}}. |

|||

* {{Searle 1980}} |

|||

:''Page numbers above refer to a standard [[pdf]] print of the article. See also Searle's [https://web.archive.org/web/20010221025515/http://www.bbsonline.org/Preprints/OldArchive/bbs.searle2.html original draft].'' |

|||

* {{Citation |

|||

| last=Searle | first=John |

|||

| year=1983 | contribution=Can Computers Think? |

|||

| editor-first=David |editor-last= Chalmers |editor-link=David Chalmers |

|||

| title=Philosophy of Mind: Classical and Contemporary Readings |

|||

| publisher=Oxford University Press | location=Oxford |

|||

| isbn= 978-0-19-514581-6 |

|||

| pages= 669–675 |

|||

| ref=none |

|||

}} |

|||

* {{Citation |

|||

| last=Searle | first=John |

|||

| year=1984 |

|||

| title=Minds, Brains and Science: The 1984 Reith Lectures |

|||

| publisher=Harvard University Press |

|||

| isbn=978-0-674-57631-5 |

|||

}} paperback: {{ISBN|0-674-57633-0}}. |

|||

* {{Citation |

|||

| last=Searle | first=John |

|||

| title=Is the Brain's Mind a Computer Program? |

|||

| magazine=Scientific American | volume=262 | issue=1 |

|||

| date=January 1990| pages=26–31 |

|||

| pmid=2294583 | doi=10.1038/scientificamerican0190-26 |

|||

| bibcode=1990SciAm.262a..26S}} |

|||

* {{Citation |

|||

|last = Searle |

|||

|first = John |

|||

|year = 1990 |

|||

|title = Is the Brain a Digital Computer? |

|||

|journal = Proceedings and Addresses of the American Philosophical Association |

|||

|volume = 64 |

|||

|issue = November |

|||

|pages = 21–37 |

|||

|url = https://mywebspace.wisc.edu/lshapiro/web/Phil554_files/SEARLE-BDC.HTM |

|||

|doi = 10.2307/3130074 |

|||

|deadurl = yes |

|||

|archiveurl = https://web.archive.org/web/20121114093932/https://mywebspace.wisc.edu/lshapiro/web/Phil554_files/SEARLE-BDC.HTM |

|||

|archivedate = 2012-11-14 |

|||

|df = |

|||

|jstor = 3130074 |

|||

}} |

|||

* {{Citation |

|||

| last=Searle | first=John |

|||

| year=1992 |

|||

| title=The Rediscovery of the Mind |

|||

| publisher=M.I.T. Press| location=Cambridge, Massachusetts |

|||

|url={{google books |plainurl=y |id=eoh8e52wo_oC}} |

|||

|isbn=978-0-262-26113-5}} |

|||

* {{Citation |

|||

| last=Searle | first=John |

|||

| year = 1999 |

|||

| title = Mind, language and society | isbn = 978-0-465-04521-1 |

|||

| publisher = Basic Books | location = New York, NY |

|||

| oclc = 231867665 }} |

|||

* {{Citation |

|||

| last=Searle | first=John |

|||

| title = Mind: a brief introduction |

|||

| publisher=Oxford University Press, Inc. |

|||

| isbn=978-0-19-515733-8 |

|||

|url={{google books |plainurl=y |id=oSm8JUHJXqcC}} |

|||

|date=1 November 2004 |

|||

}} |

|||

* {{Citation | last=Searle | first=John |

|||

| year=2002 |

|||

| title=Consciousness and Language |

|||

| url={{google books |plainurl=y |id=bvxhV-1Duz8C|page=16}} |

|||

| page=16 |

|||

| isbn= 978-0521597449 |

|||

| publisher=Cambridge University Press |

|||

}} |

|||

* {{Citation | last=Searle | first=John |

|||

| year=2009 |

|||

| title=Chinese room argument |

|||

| journal=Scholarpedia | volume=4 | number=8 |

|||

| doi=10.4249/scholarpedia.3100 | pages=3100 |

|||

| bibcode=2009SchpJ...4.3100S}} |

|||

* {{Turing 1950}} |

|||

:''Page numbers above refer to a standard [[pdf]] print of the article.'' |

|||

* {{Citation |

|||

| last = Yee | first = Richard |

|||

| year = 1993 |

|||

| title = Turing Machines And Semantic Symbol Processing: Why Real Computers Don't Mind Chinese Emperors |

|||

| journal = Lyceum |

|||

| volume=5 | issue=1 |

|||

| pages=37–59 |

|||

| url = http://lyceumphilosophy.com/Lyceum-5-1.pdf |

|||

}} |

|||

:''Page numbers above and diagram contents refer to the Lyceum [[pdf]] print of the article.'' |

|||

{{refend}} |

|||

== Література == |

== Література == |

||

Версія за 05:44, 28 травня 2019

Аргуме́нт кита́йської кімна́ти стверджує, що виконання програми не може бути «розумом», «розумінням» або «свідомістю» незалежно від того, наскільки програма забезпечує комп'ютеру поведінку розумної людини. Цей аргумент був вперше представлений філософом Джоном Серлем у своїй роботі «Minds, Brains, and Programs» («Розум, мізки і програми»), опублікованій в 1980 році в журналі Behavioral and Brain Sciences[en]. З тих пір він широко обговорювався.[1] Центральним елементом аргументу є уявний експеримент, відомий як китайська кімната.[2]

Аргумент спрямований проти філософських позицій[en] функціоналізму та комп'ютерної теорії розуму,[3] які вважають, що розум можна розглядати як систему обробки інформації, що оперує формальними символами. Зокрема, аргумент намагається спростувати позицію, яку Серль називає сильним штучним інтелектом: «Належним чином запрограмований комп'ютер з правильними вхідними і вихідними даними, матиме розум в точно такому ж сенсі, як людина має розум».

Хоча аргумент китайської кімнати спочатку був представлений у відповідь на висловлювання дослідників штучного інтелекту (ШІ), він не є аргументом проти цілей дослідження ШІ, оскільки не обмежує силу інтелекту, яку може демонструвати машина.[4] Аргумент застосовується тільки до цифрових комп'ютерів, на яких виконуються програми, і не поширюється на машини в цілому.[5]

Уявний експеримент

У популярній статті «Is the Brain's Mind a Computer Program?» («Чи є мозкове мислення комп'ютерною програмою?»), опублікованій у 1990 році, Серль описує експеримент таким чином:

|

Візьмемо, наприклад, яку-небудь мову, якої ви не розумієте. Для мене такою мовою є китайська. Текст, написаний китайською, я сприймаю як набір безглуздих каракулів. Тепер припустимо, що мене помістили в кімнату, в якій розставлені кошики, повні китайських ієрогліфів. Припустимо також, що мені дали підручник англійською мовою, в якому наводяться правила поєднання символів китайської мови, причому правила ці можна застосовувати, знаючи лише форму символів, розуміти значення символів зовсім необов'язково. Наприклад, правила можуть твердити: «Візьміть такий-то ієрогліф з кошика номер один і помістіть його поряд з таким-то ієрогліфом з кошика номер два». Уявімо собі, що люди, які перебувають за дверима кімнати і розуміють китайську мову, передають у кімнату набори символів, і що у відповідь я маніпулюю символами відповідно до правил і передаю назад інші набори символів. У цьому випадку книга правил є не що інше, як «комп'ютерна програма». Люди, які написали її, - «програмісти», а я граю роль «комп'ютера». Кошики, наповнені символами, - це «база даних»; набори символів, що передаються до кімнати, це «питання», а набори, що виходять з кімнати, це «відповіді». Припустимо далі, що книга правил написана так, що мої «відповіді» на «питання» не відрізняються від відповідей людини, яка вільно розмовляє китайською мовою. Наприклад, люди, що знаходяться зовні, можуть передати незрозумілі мені символи, що означають: «Який колір вам більше всього подобається?» У відповідь, виконавши запропоновані правилами маніпуляції, я видам символи, на жаль, мені також незрозумілі, що означають, що мій улюблений колір синій, але мені насправді подобається зелений. Таким чином, я витримаю тест Тюрінга на розуміння китайської мови. Але все ж насправді я не розумію ані слова китайською. До того ж, я ніяк не можу навчитися цій мові у розглянутій системі, оскільки не існує жодного способу, за допомогою якого я міг би довідатися сенс хоча б одного символу. Подібно до комп'ютера, що маніпулює символами, але не може вкласти в них жодного змісту. |

Серль стверджує, що без «розуміння» (або «інтенціональності») ми не можемо описати те, що робить машина як «мислення», і, оскільки вона не думає, вона не має «розуму». Тому він робить висновок, що «сильний ШІ» є помилковим.

Історія

У 1714 р. Готфрід Лейбніц зформував подібний аргумент проти механізму[en] (позиції про те, що розум є машиною і не більше). Лейбніц використовував уявний експеримент розширення мозку, поки він не став розміром з млин.[6] Лейбніцю було важко уявити, що «розум», здатний до «сприйняття», може бути побудований з використанням тільки механічних процесів. У короткому оповіданні 1961 року «Гра» Анатолія Дніпрова стадіон людей виступає перемикачами та осередками пам'яті, які реалізують програму перекладу фрази португальської мови, яку ніхто з них не знає.[7] У 1974 році Лоуренс Девіс уявляв собі дублювання мозку за допомогою телефонних ліній і офісів, у яких працювали люди, і в 1978 році Нед Блок передбачив, що все населення Китаю бере участь у такому моделюванні мозку. Цей розумовий експеримент називається Китайський мозок, також "китайська нація" або "китайський тренажерний зал".[8]

Аргумент китайської кімнати був введений в 1980 році в документі Серля "Minds, Brains, and Programs" ("Розум, мозок і програми"), опублікований в журналі Behavioral and Brain Sciences[en].[9] У підсумку вона стала "найвпливовішою цільовою статтею" журналу,[1] яка генерувала величезну кількість коментарів і відповідей у наступні десятиліття, і Серль продовжував захищати і уточнювати аргумент у багатьох статтях і книгах. Девід Коул пише, що "аргумент китайської кімнати, ймовірно, був найбільш широко обговорюваним філософським аргументом у когнітивній науці, який з'явився за останні 25 років".[10]

Більшість дискусій складається зі спроб спростування аргументу. "Переважна більшість, - відзначає редактор BBS Стеван Харнад, - як і раніше думає, що китайський аргумент кімнати мертвий".[11] Об'єм літератури, що виріс навколо дискусії, надихнув Пата Хейса на коментар, що поле когнітивної науки має бути переосмислено як "триваюча дослідницька програма, яка показує, що аргумент китайської кімнати Серля є помилковим".[12]

Аргумент Серля став "чимось класичним у когнітивній науці", стверджує Харнад. Варол Акман погодився і охарактеризував оригінальну статтю як «зразок філософської чіткості і чистоти».[13]

Філософія

Хоча аргумент китайської кімнати спочатку був представлений у відповідь на висловлювання дослідників інтелектуальної власності, філософи стали розглядати його як важливу частину філософії свідомості. Це виклик функціоналізму і теорії комп'ютерного розуму, і пов'язаний з такими питаннями, як проблема розум-тіло, проблема інших розумів[en], проблема-заземлення[en], і важка проблема свідомості.

Сильний ШІ

Серль визначив філософську позицію, яку він називає "сильним ШІ":

| Належним чином запрограмований комп'ютер з правильними входами і виходами, таким чином, матиме розум в точно такому ж сенсі, як люди мають розум. |

Визначення залежить від відмінності між імітацією розуму та реальним розумом. Серль пише, що "згідно з Сильним ШІ, правильне моделювання дійсно є розумом. Згідно зі Слабким ШІ, правильне моделювання є моделлю розуму".[14]

Ця позиція випливає з деяких висловлювань дослідників та аналітиків раннього ШІ. Наприклад, у 1955 році засновник AI Герберт А. Саймон заявив,[15] що "зараз у світі є машини, які думають, що навчаються і створюють" і стверджують, що вони "вирішили поважну проблему розуму і тіла", пояснюючи, як система, що складається з матерії, може володіти властивостями розуму."[16] Джон Хегленд[en] писав, що "ШI хоче тільки справжню статтю: машини з розумом, в повному і буквальному сенсі. Це не наукова фантастика, а реальна наука, що ґрунтується на теоретичній концепції настільки глибокій, наскільки вона є сміливою, а саме, ми, насамперед, самі є комп'ютерами».[17]

Серль також приписує наступні позиції захисникам сильного ШІ:

- Системи штучного інтелекту можна використовувати для пояснення розуму;

- Вивчення мозку не має відношення до вивчення розуму;

- Тест Тьюрінга є достатнім для встановлення існування психічних станів.

Сильний ШІ, як комп'ютерна теорія розуму або функціоналізм

У більш пізніх презентаціях аргументу китайської кімнати, Серль визначив "сильний ШI" як "комп'ютерний функціоналізм" (термін він приписує Даніелю Деннетту).[3][18] Функціоналізм - це позиція в сучасній філософії свідомості, яка передбачає, що ми можемо визначати психічні явища (такі як вірування, бажання і сприйняття), описуючи їхні функції по відношенню один до одного і до зовнішнього світу. Згідно з функціоналізмом, оскільки комп'ютерна програма може точно представляти функціональні відносини як відносини між символами, комп'ютер може мати психічні явища, якщо він виконує правильну програму.

Стівен Харнад[en] стверджує, що уявлення Серля про сильний ШI можна переформулювати як "впізнавані принципи обчислювальної діяльності, позиція (на відміну від "сильного ШI"), якої фактично дотримуються багато мислителів, і отже, ця позиція варта спростування.[19] Комп'ютерна теорія розуму це позиція у філософії розуму, яка стверджує, що розум можна точно описати як систему обробки інформації.

Кожен з наступних пунктів, на думку Харнада, є "принципом" комп'ютерної теорії розуму:[20]

- Психічні стани є обчислювальними станами (тому комп'ютери можуть мати психічні стани і допомагати пояснити розум);

- Обчислювальні стани є незалежним від реалізації[en] - інакше кажучи, саме програмне забезпечення визначає обчислювальний стан, а не апаратні засоби (тому мозок, будучи апаратним, не має значення);

- Оскільки реалізація не має значення, єдині емпіричні дані, які мають значення, це як функціонує система; отже, тест Тьюрінга є остаточним.

Сильний ШІ проти біологічного натуралізму

Серль займає філософську позицію, яку він називає «біологічним натуралізмом[en]»: свідомість і розуміння вимагають особливого біологічного механізму, який міститься в мозку. Він пише «мозок викликає думку»[5] і що «фактичні людські психічні явища залежать від реальних фізико-хімічних властивостей реальних людських мізків».[21] Серль стверджує, що цей механізм (відомий нейронауці як "нейронні кореляти свідомості[en]") повинен мати деякі (невизначені) "причинні сили", які дозволяють людському досвіду бути свідомостю.[22] Віра Серля в існування цих повноважень була піддана критиці.

Серль погоджується з тим, що машини можуть мати свідомість і розуміння, тому що, як він пише, «ми є саме такими машинами».[5] Серль вважає, що мозок, по суті, є машиною, але він дає початок свідомості і розуміння, використовуючи механізми, які не є обчислювальними. Якщо неврологія здатна ізолювати механічний процес, який породжує свідомість, то Серль надає можливість створити машини, які мають свідомість і розуміння. Однак, без специфічної техніки, Серль не вірить, що свідомість можна відтворити.

Біологічний натуралізм передбачає, що неможливо визначити, чи можна створити свідомість лише шляхом вивчення того, як функціонує система, оскільки особлива техніка головного мозку є суттєвою. Таким чином, біологічний натуралізм прямо протистоїть як біхевіоризму, так і функціоналізму (включаючи «комп'ютерний функціоналізм» або «сильний ШІ»).[23] Біологічний натуралізм подібний до теорії ідентичності (положення, що психічні стани "ідентичні" або "складаються з" неврологічних подій); однак, Серль має специфічні технічні заперечення проти теорії тотожності.[24] Біологічний натуралізм Серля і сильний ШІ протиставляються декартовому дуалізму, класичній ідеї про те, що мозок і розум складаються з різних "речовин". Дійсно, Серль звинувачує сильний ШI в дуалізмі,[23] пишучи, що «сильний ШI має сенс лише з огляду на дуалістичне припущення, що там, де розум стурбований, мозок не має значення».[25]

Свідомість

Оригінальна презентація Серля підкреслювала «розуміння» - тобто, психічні стани, які філософи називають «інтенціональністю», і безпосередньо не зверталися до інших тісно пов'язаних ідей, таких як «свідомість». Однак у більш пізніх презентаціях Серль включив свідомість як справжню мету аргументу.[3]

| Моделі комп'ютерної теорії розуму самі по собі недостатні для свідомості. Комп'ютерна теорія розуму ґрунтується на свідомості так само, як обчислювальна модель чого-небудь ґрунтується на модельованому домені. Ніхто не припускає, що обчислювальна модель дощів у Лондоні залишить нас мокрими. Але вони роблять помилку, вважаючи, що комп'ютерна теорія розуму має якусь свідомість. Це одна й та ж помилка в обох випадках. | ||

— Джон Р. Серль, Свідомість і мова, с. 16 | ||

Девід Чалмерс пише: "цілком зрозуміло, що свідомість знаходиться в корені питання" китайської кімнати.[26]

Колін Макгінн стверджує, що китайська кімната надає вагомі докази того, що важка проблема свідомості є принципово нерозв'язною. Аргумент, щоб бути зрозумілим, полягає не в тому, чи може машина бути свідомою, а в тому, чи може він (або що-небудь інше) бути свідомим. Зрозуміло, що будь-який інший метод перевірки окупанта китайської кімнати має такі ж принципові труднощі, як обмін питаннями і відповідями на китайській мові. Це просто неможливо визначити, чи є у приміщенні хтось свідомий або якесь розумне моделювання.[27]

Серль стверджує, що це справедливо лише для спостерігача поза кімнатою. Вся думка експерименту полягає в тому, щоб помістити людину всередину кімнати, де вони можуть безпосередньо спостерігати за операціями свідомості. Серль стверджує, що з його точки зору в кімнаті немає нічого, що, на його погляд, могло бути свідомістю, крім себе, і явно не має розуму, який може говорити по-китайськи.

Прикладна етика

Патрік Хью використовував аргумент китайської кімнати, щоб вивести вимоги від військових систем управління і командування, якщо вони хочуть зберегти моральне керівництво командира. Він провів аналогію між командувачем у їхньому командному центрі і людиною в китайській кімнаті і проаналізував її читаючи поняття Арістотеля про "обов'язки" і "незнання". Інформація може бути "перетворена" з сенсу в символи і маніпулюватися символічно, але моральне втручання могло бути підірване, якщо було неадекватне "перетворення" в сенс. Хью цитував приклади інциденту USS Vincennes.[28]

Інформатика

Аргумент китайської кімнати - це, перш за все, аргумент у філософії свідомості, і як головні дослідники у сфері інформатики, так і дослідники штучного інтелекту вважають це незначним для їхніх галузей.[4] Однак, кілька концепцій, розроблених вченими у сфері інформатики, мають важливе значення для розуміння аргументу, включаючи обробку символів, машини Тьюрінга, повноту Тьюрінга і тест Тьюрінга.

Сильний ШІ проти дослідження ШІ

Аргументи Серля зазвичай не розглядаються як питання для дослідження ШІ. Стюарт Рассел і Пітер Норвіг зауважують, що більшість дослідників інтелектуальної власності "не піклуються про сильну гіпотезу ШІ - до тих пір, поки програма працює, їм не важливо, чи називаєте ви це імітацією інтелекту або реальним інтелектом".[4] Основна місія дослідження штучного інтелекту полягає лише в тому, щоб створити корисні системи, які діють розумно, і це не має значення, якщо інтелект є «просто» імітацією.

Серль не погоджується з тим, що дослідження ШІ можуть створювати машини, здатні до високоінтелектуальної поведінки. Аргумент китайської кімнати залишає відкритою можливість того, що може бути побудована цифрова машина, яка діє більш розумно, ніж людина, але не має розуму або інтенціональності так само, як це робить мозок. Аргумент китайської кімнати не є доведеним до абсурду, а є прикладом, який вимагає пояснення.

"Сильний ШІ" Серля не слід плутати із "сильним ШІ", як це визначено Реймондом Курцвейлом та іншими футуристами,[29] які використовують цей термін для опису машинного розуму, який конкурує або перевершує людський інтелект. Курцвейл спирається, головним чином, на кількість інтелекту, що відображається машиною, тоді як аргумент Серля не обмежує цього. Серль стверджує, що навіть супер-розумна машина не обов'язково має розум і свідомість.

Тест Тьюрінга

Китайська кімната реалізує варіант тесту Тьюрінга.[30] Алан Тьюрінг ввів тест в 1950 році, щоб допомогти відповісти на питання «чи може машина мислити?» У стандартній версії, людина-суддя бере участь в розмові на природній мові з людиною і машиною, призначеної для генерації продуктивності неотличимой від людських істот. Всі учасники розділені один від одного. Якщо суддя не може надійно відрізнити машину від людини, машина, як кажуть, пройшла тест.

Тьюрінг потім розглянув кожні з можливих заперечень проти пропозиції «машини можуть думати», і виявив, що є прості, очевидні відповіді, якщо питання де-спантеличені таким чином. Він, однак, не призначається для випробування вимірювання наявності «свідомості» або «розуміння». Він не вірив, що це ставлення до проблем, з якою він звертався. Він писав:

| Я не хочу створити враження, що я думаю, що немає ніякої таємниці свідомості. Існує, наприклад, щось схоже на парадокс, пов'язаний з будь-якими спробами локалізувати його. Але я не думаю, що ці таємниці обов'язково повинні бути вирішені перш, ніж ми можемо відповісти на питання, які турбують нас в цій статті. |

Для Серля, як філософа, який працює в галузі розуму і свідомості, це відповідні таємниці. Китайська кімната призначена, щоб показати, що тест Тьюрінга є недостатнім для виявлення присутності свідомості, навіть якщо в кімнаті може бути машина, що функціонує як свідомий розум.

Обробка символів

Китайська кімната (і всі сучасні комп'ютери) маніпулює фізичними об'єкти для того, щоб проводити розрахунки і робити моделювання. Дослідники штучного інтелекту Аллен Ньюелл і Герберт А. Саймон назвали це свого роду машиною, фізичною системою символів. Це еквівалентно також формальним системам, використовуваних в галузі математичної логіки.

Серль підкреслює той факт, що подібного роду маніпуляції символами є синтаксичними (запозичуючи термін з вивчення граматики). Комп'ютер маніпулює символами, використовуючи форму синтаксичних правил, без яких-небудь знань про семантику символів (тобто їх зміст).

Ньюелл і Саймон припустив, що фізична система символів (наприклад, цифровий комп'ютер) мав все необхідне обладнання для «загальної інтелектуальної дії», або, як це відомо сьогодні, загальний штучний інтелект. Вони описали це як філософську позиція, гіпотези фізичної системи символів: «Фізична система символу має необхідні і достатні умови для загальнї інтелектуальної дії».[31][32] Аргумент китайської кімнати не спростовує це, тому що він оформлений з точки зору «розумних дій», тобто зовнішня поведінка машини, а не наявність або відсутність розуміння свідомості і розуму.

Китайська кімната та Тьюрінгова повнота