Глибоке навчання

| Частина з циклу про |

| Штучний інтелект |

|---|

|

Словник |

Глибо́ке навча́ння[2][3][4] (англ. deep learning, також іноді глиби́нне навча́ння) — це підмножина методів машинного навчання на основі штучних нейронних мережах із навчанням подань. Прикметник «глибоке» (англ. "deep") вказує на використання декількох шарів у мережі. Використовувані методи навчання можуть бути керованими, напівкерованими, та некерованими.[5]

Архітектури глибокого навчання, такі як глибокі нейронні мережі, глибокі мережі переконань, рекурентні нейронні мережі, згорткові нейронні мережі та трансформери, застосовували в таких галузях як комп'ютерне бачення, розпізнавання мовлення, обробка природної мови, машинний переклад, біоінформатика, конструювання ліків, аналіз медичних зображень[en], кліматологія, перевірка матеріалів і програми настільних ігор, де вони дали результати, порівня́нні, а в деяких випадках і кращі за продуктивність людських експертів.[6][7][8]

Штучні нейронні мережі (ШНМ) було натхненно обробкою інформації та розподіленими комунікаційними вузлами в біологічних системах. ШНМ мають різноманітні відмінності від біологічного мозку. Зокрема, штучні нейронні мережі зазвичай статичні та символьні, тоді як біологічний мозок більшості живих організмів динамічний (пластичний) та аналоговий.[9][10] ШНМ загалом розглядають як низькоякісні моделі функціювання мозку.[11]

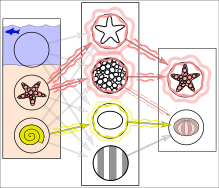

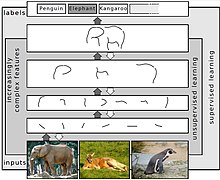

Глибоке навчання — це клас алгоритмів машинного навчання, який[12] використовує декілька шарів, щоби поступово виділяти з сирого входу ознаки щоразу вищих рівнів. Наприклад, при обробці зображень нижчі шари можуть встановлювати контури, тоді як вищі шари можуть встановлювати поняття, доречні для людини, такі як цифри, літери чи обличчя.

Якщо поглянути на глибоке навчання під іншим кутом, то глибоке навчання позначує «комп'ютерне моделювання» або «автоматизацію» процесів навчання людиною від джерела (наприклад, зображення собак) до об'єкта навчання (собак). Тому мають сенс поняття, сформульовані як «глибше» (англ. "deeper") та «найглибше» (англ. "deepest") навчання.[13] Найглибше навчання позначує повністю автоматичне навчання від джерела до кінцевого об'єкта навчання. Глибше навчання відтак позначує змішаний процес навчання: процес навчання людиною від джерела до навченого напівоб'єкта, за яким слідує комп'ютерний процес навчання від навченого людиною напівоб'єкта до кінцевого об'єкта навчання.

Більшість сучасних моделей глибокого навчання ґрунтуються на багатошарових штучних нейронних мережах, таких як згорткові нейронні мережі та трансформери, хоча до них також можуть належати пропозиційні формули[en] та латентні змінні, організовані пошарово в глибоких породжувальних моделях, такі як вузли в глибоких мережах переконань чи глибоких машинах Больцмана.[14]

У глибокому навчанні кожен рівень вчиться перетворювати свої вхідні дані на дещо абстрактніше й складніше подання. У застосунку для розпізнавання зображень сирий вхід може бути матрицею пікселів; перший шар подання може абстрагуватися від пікселів і кодувати контури; другий шар може складати та кодувати їхнє розташування; третій шар може кодувати ніс та очі; а четвертий шар може розпізнавати, що зображення містить обличчя. Важливо, що процес глибокого навчання може самостійно вчитися, які ознаки оптимально розмістити на якому рівні. Це не звільняє від необхідності ручного настроювання; наприклад, різна кількість та розміри шарів можуть забезпечувати різні ступені абстракції.[15][16]

Слово «глибоке» у «глибокому навчанні» позначує кількість шарів, крізь які перетворюються дані. Точніше, системи глибокого навчання мають значну глибину шляху розподілу внеску (ШРВ, англ. credit assignment path, CAP). ШРВ — це ланцюг перетворень від входу до виходу. ШРВ описують потенційно причинно-наслідкові зв'язки між входом та виходом. Для нейронної мережі прямого поширення глибина ШРВ дорівнює глибині мережі й є кількістю прихованих шарів плюс один (оскільки шар виходу також параметризовано). Для рекурентних нейронних мереж, у яких сигнал може поширюватися крізь шар понад один раз, глибина ШРВ потенційно необмежена.[17] Немає універсально узгодженого порогу глибини, який відділяє неглибоке навчання (англ. shallow learning) від глибокого, але більшість дослідників сходяться на думці, що глибоке навчання використовує глибину ШРВ вище 2. Було показано, що ШРВ глибини 2 це універсальний наближувач у тому сенсі, що він може моделювати будь-яку функцію.[18] Поза цим, більше шарів не додають нічого до здатності мережі наближувати функції. Глибокі моделі (ШРВ > 2) здатні виділяти кращі ознаки, ніж неглибокі моделі, й отже, додаткові шари допомагають ефективно навчатися ознак.

Архітектури глибокого навчання можливо конструювати пошарово жадібним методом.[19] Глибоке навчання допомагає розплутувати ці абстракції й обирати, які ознаки покращують продуктивність.[15]

Для завдань керованого навчання методи глибокого навчання уможливлюють усування конструювання ознак, переводячи дані до компактних проміжних подань, подібних до головних компонент, і виводять багатошарові структури, які усувають надмірність у поданні.

Алгоритми глибокого навчання можливо застосовувати до завдань некерованого навчання. Це важлива перевага, оскільки немічені дані численніші за мічені. Прикладами глибоких структур, які можливо тренувати некерованим чином, є глибокі мережі переконань.[15][20]

Моделі машинного навчання тепер вправні у виявлянні складних шаблонів у даних фінансових ринків. Завдяки перевагам штучного інтелекту інвестори все частіше використовують методики глибокого навчання для прогнозування та аналізу тенденцій на фондових та валютних ринках.[21]

Глибокі нейронні мережі зазвичай інтерпретують у термінах теореми про універсальне наближення[22][23][24][25][26] або ймовірнісного висновування.[27][12][15][17][28]

Класична теорема про універсальне наближення стосується здатності нейронної мережі прямого поширення з одним прихованим шаром скінченного розміру наближувати неперервні функції.[22][23][24][25] 1989 року Джордж Цибенко опублікував перше її доведення для сигмоїдних передавальних функцій,[22] а 1991 року Курт Горнік[de] узагальнив його для багатошарових архітектур прямого поширення.[23] Нещодавня робота також показала, що універсальне наближення також виконується для необмежених передавальних функцій, таких як випрямлений лінійний вузол (англ. rectified linear unit) Куніхіко Фукусіми[en].[29][30]

Теорема про універсальне наближення для глибоких нейронних мереж розглядає пропускну спроможність мереж з обмеженою шириною, дозволяючи зростати глибині. Лу зі співавт.[26] довели, що якщо ширина глибокої нейронної мережі з передавальною функцією ReLU строго більша за розмірність входу, то ця мережа може наближувати будь-яку функцію, інтегровну за Лебегом; якщо її ширина менша або дорівнює розмірності входу, то глибока нейронна мережа не є універсальним наближувачем.

Імовірнісна інтерпретація[28] походить з галузі машинного навчання. Вона відводить провідне місце висновуванню,[12][14][15][17][20][28] а також таким поняттям оптимізації як тренування та випробування, пов'язаним із допасовуванням та узагальнюванням відповідно. Конкретніше, ймовірнісна інтерпретація розглядає нелінійність передавальної функції як кумулятивну функцію розподілу.[28] Імовірнісна інтерпретація призвела до запровадження виключення (англ. dropout) як регуляризатора в нейронних мережах. Імовірнісну інтерпретацію було запроваджено дослідниками включно з Гопфілдом, Уїдроу[en] та Нарендрою[en], й популяризовано в оглядах, таких як від Бішопа[en].[31]

Існує два типи нейронних мереж: нейронні мережі прямого поширення (НМПП, англ. feedforward neural network, FNN) та рекурентні нейронні мережі (РНМ, англ. recurrent neural network, RNN). РНМ мають цикли у структурі зв'язності, а НМПП — ні. У 1920-х роках Вільгельм Ленц[en] та Ернст Ізінг[en] створили та проаналізували модель Ізінга,[32] яка, по суті, є архітектурою РНМ, що не навчається, і складається з нейроноподібних порогових елементів. 1972 року Шунічі Амарі[en] зробив цю архітектуру адаптивною.[33][34] Його навчання РНМ популяризував Джон Гопфілд 1982 року.[35] РНМ стали центральними для розпізнавання мовлення та обробки мови[en].

Чарльз Тапперт пише, що Френк Розенблат розробив та дослідив усі основні складові сучасних систем глибокого навчання,[36] посилаючись на книгу Розенблата 1962 року,[37] якою було запроваджено багатошаровий перцептрон (БШП) із 3 шарами: шаром входу, прихованим шаром із випадковими вагами, що не навчалися, та шаром виходу. Він також запропонував варіанти, включно з версією з чотирьохшаровими перцептронами, де останні два шари мають ваги, що навчаються (й отже, справжній багатошаровий перцептрон).[37] Крім того, термін глибоке навчання запропонувала 1986 року Ріна Дехтер[en],[38] хоча історія його появи, схоже, набагато складніша.[39]

Перший загальний, робочий алгоритм навчання для глибоких багатошарових перцептронів прямого поширення керованим навчанням опублікували 1967 року Олексій Івахненко та Валентин Лапа.[40] У статті 1971 року описано глибоку мережу з восьми шарів, треновану методом групового урахування аргументів.[41]

Перший багатошаровий перцептрон глибокого навчання, тренований стохастичним градієнтним спуском,[42] опублікував 1967 року Шунічі Амарі[en].[43][34] У комп'ютерних експериментах, проведених учнем Амарі, Сайто, п'ятишаровий БШП із двома змінними шарами навчився внутрішніх подань для класифікування нелінійно роздільних класів образів.[34] 1987 року Метью Бренд повідомив, що широкі 12-шарові нелінійні перцептрони можливо повністю наскрізно тренувати відтворювати логічні функції нетривіальної глибини ланцюга за допомогою градієнтного спуску на невеликих пакетах випадкових вибірок входів/виходів, але зробив висновок, що час тренування на тогочасному обладнанні (домегафлопних комп'ютерах) зробив цю методику непрактичною, та запропонував використовувати незмінні випадкові ранні шари як хеш входу для єдиного змінюваного рівня.[44] Натомість подальші розробки апаратного забезпечення та підлаштовування гіперпараметрів зробили наскрізний стохастичний градієнтний спуск нині переважною методикою тренування.

1970 року Сеппо Ліннаінмаа[en] опублікував зворотний режим автоматичного диференціювання дискретно зв'язаних мереж вкладених диференційовних функцій.[45][46][47] Він став відомим як зворотне поширення.[17] Це ефективне застосування ланцюгового правила, виведеного Готфрідом Вільгельмом Лейбніцем 1673 року,[48] до мереж диференційовних вузлів.[34] Термінологію «зворотно поширювані похибки» (англ. "back-propagating errors") фактично запровадив 1962 року Розенблат,[37][34] але він не знав, як це втілити, хоча Генрі Келлі[en] вже 1960 року мав безперервного попередника зворотного поширення[49] в контекст теорії керування.[34] 1982 року Пол Вербос[en] застосував зворотне поширення до БШП у спосіб, який став стандартним.[50][51][34] 1985 року Девід Румельхарт зі співавт. опублікували експериментальний аналіз цієї методики.[52]

Ахітектури глибокого навчання для згорткових нейронних мереж (ЗНМ, англ. convolutional neural networks, CNN) зі згортковими шарами та шарами зниження роздільності почалися з неокогнітрона, запропонованого Куніхіко Фукусімою[en] 1980 року.[53] 1969 року він також запропонував передавальну функцію ReLU (англ. rectified linear unit, випрямлений лінійний вузол).[29][34] Цей випрямляч (англ. rectifier) став найпопулярнішою передавальною функцією для ЗНМ та глибокого навчання в цілому.[54] ЗНМ стали важливим інструментом комп'ютерного бачення.

Термін глибоке навчання (англ. Deep Learning) у спільноті машинного навчання запровадила 1986 року Ріна Дехтер[en],[38] а для штучних нейронних мереж — Ігор Айзенберг з колегами у 2000 року в контексті булевих[en] порогових нейронів.[55][56]

1988 року Вей Чжан зі співавт. застосували алгоритм зворотного поширення до згорткової нейронної мережі (спрощений неокогнітрон зі згортковими взаємозв'язками між шарами ознак зображення та останнім повноз'єднаним шаром) для розпізнавання абетки. Вони також запропонували втілення ЗНМ з оптичною обчислювальною системою.[57][58] 1989 року Ян ЛеКун зі співавт. застосували зворотне поширення до ЗНМ з метою розпізнавання рукописних поштових індексів у пошті. Хоч цей алгоритм і працював, тренування вимагало 3 днів.[59] Згодом Вей Чжан зі співавт. видозмінили свою модель, видаливши останній повноз'єднаний шар, та застосувавши її для сегментування об'єктів медичних зображень 1991 року,[60] та для виявляння раку молочної залози на мамограмах 1994 року.[61] LeNet-5 (1998), 7-рівневу ЗНМ від Яна ЛеКуна зі співавт.,[62] що класифікує цифри, кілька банків застосували для розпізнавання рукописних чисел на чеках, оцифрованих у зображення 32×32 пікселі.

У 1980-х роках зворотне поширення не працювало добре для глибокого навчання з довгими шляхами розподілу внеску. Щоби подолати цю проблему, Юрген Шмідхубер (1992) запропонував ієрархію РНМ, попередньо тренованих порівнево самокерованим навчанням.[63] Вона використовує передбачувальне кодування[en] для навчання внутрішніх подань у кількох самоорганізованих масштабах часу. Це може істотно полегшувати наступне глибоке навчання. Цю ієрархію РНМ можливо скласти (англ. collapse) в єдину РНМ шляхом дистилювання[en] фрагментувальної (англ. chunker) мережі вищого рівня до автоматизаторної (англ. automatizer) мережі нижчого рівня.[63][34] 1993 року фрагментувальник розв'язав завдання глибокого навчання, чия глибина перевищувала 1000.[64]

1992 року Юрген Шмідхубер також опублікував альтернативу РНМ (англ. alternative to RNNs),[65] яку зараз називають лінійним трансформером (англ. linear Transformer) або трансформером з лінеаризованою самоувагою[66][67][34] (за винятком оператора нормування). Він навчається внутрішніх центрів уваги (англ. internal spotlights of attention):[68] повільна нейронна мережа прямого поширення вчиться за допомогою градієнтного спуску керувати швидкими вагами іншої нейронної мережі через тензорні добутки самопороджуваних шаблонів збудження FROM і TO (званих тепер ключем, англ. key, та значенням, англ. value, самоуваги).[66] Це відображення уваги (англ. attention mapping) швидких ваг застосовують до шаблону запиту.

Сучасний трансформер (англ. Transformer) запропонували Ашиш Васвані зі співавт. у своїй праці 2017 року «Увага — це все, що вам треба».[69] Він поєднує це з оператором softmax та проєкційною матрицею.[34] Трансформери все частіше обирають за модель для обробки природної мови.[70] Багато сучасних великих мовних моделей, таких як ChatGPT, GPT-4 та BERT, використовують саме його. Трансформери також все частіше використовують у комп'ютернім баченні.[71]

1991 року Юрген Шмідхубер також опублікував змагальні нейронні мережі (англ. adversarial neural networks), які змагаються між собою у формі антагоністичної гри, де виграш однієї мережі є програшем іншої.[72][73][74] Перша мережа є породжувальною моделлю, яка моделює розподіл імовірності над образами на виході. Друга мережа навчається градієнтним спуском передбачувати реакцію середовища на ці образи. Це було названо «штучною цікавістю» (англ. "artificial curiosity"). 2014 року цей принцип використали у породжувальній змагальній мережі (англ. generative adversarial network, GAN) Ян Ґудфелоу зі співавт.[75] Тут реакція навколишнього середовища дорівнює 1 або 0 залежно від того, чи належить вихід першої мережі до заданого набору. Це можливо використовувати для створення реалістичних дипфейків.[76] Відмінної якості зображення досягла StyleGAN[en] Nvidia (2018)[77] на основі прогресивної породжувальної змагальної мережі (англ. Progressive GAN) Теро Карраса зі співавт.[78] Тут породжувач вирощується від малого до великого пірамідним чином.

Дипломну працю Зеппа Хохрайтера[en] (1991)[79] його керівник Шмідхубер назвав «одним із найважливіших документів в історії машинного навчання».[34] Він не лише випробував нейронний стискач історії,[63] але й виявив та проаналізував проблему зникання градієнта.[79][80] Для розв'язання цієї проблеми Хохрайтер запропонував рекурентні залишкові зв'язки. Це призвело до появи методу глибокого навчання, званого довгою короткочасною пам'яттю (ДКЧП, англ. long short-term memory, LSTM), опублікованого 1997 року.[81] Рекурентні нейронні мережі ДКЧП можуть навчатися задач «дуже глибокого навчання»[17] з довгими шляхами розподілу внеску, які вимагають спогадів про події, що відбулися тисячі дискретних часових кроків тому. «Стандартну ДКЧП» (англ. vanilla LSTM) із забувальним вентилем запропонували 1999 року Фелікс Ґерс[en], Шмідхубер та Фред Каммінс.[82] ДКЧП стала найцитованішою нейронною мережею XX століття.[34] 2015 року Рупеш Кумар Шрівастава, Клаус Ґрефф і Шмідхубер використали принцип ДКЧП для створення магістралевої мережі, нейронної мережі прямого поширення з сотнями шарів, набагато глибшої за попередні.[83][84] 7 місяців потому, Каймін Хе, Сян'ю Чжан; Шаоцін Рен та Цзянь Сунь виграли змагання ImageNet[en] 2015 із відкритовентильним або безвентильним варіантом магістралевої мережі, названим за́лишковою нейронною мережею (англ. Residual neural network).[85] Вона стала найцитованішою нейронною мережею XXI століття.[34]

1994 року Андре де Карвальо разом з Майком Фейргерстом та Девідом Біссетом опублікували експериментальні результати багатошарової булевої нейронної мережі, відомої також як безвагова нейронна мережа (англ. weightless neural network), складеної з 3-шарового самоорганізовуваного нейромережного модуля виділяння ознак (англ. SOFT), з багатошаровим класифікаційним нейромережним модулем (англ. GSN) за ним, тренованих незалежно. Кожен шар у модулі виділяння ознак виділяв ознаки все вищої складності відносно попереднього шару.[86]

1995 року Брендан Фрей[en] продемонстрував можливість натренувати (протягом двох днів) мережу із шести повноз'єднаних шарів та кількох сотень прихованих вузлів, використовуючи алгоритм неспання — сну[en], розроблений спільно з Пітером Даяном[en] та Гінтоном.[87]

З 1997 року Свен Бенке розширив ієрархічний згортковий підхід прямого поширення у нейронній піраміді абстракцій (англ. Neural Abstraction Pyramid)[88] за допомогою бічних та зворотних з'єднань, щоби гнучко включати контекст у рішення та ітеративно розв'язувати локальні неоднозначності.

У 1990-х і 2000-х роках популярністю користувалися простіші моделі, які використовують сконструйовані вручну ознаки для конкретних завдань, такі як фільтри Ґабора (англ. Gabor filters) та опорновекторні машини (ОВМ, англ. support vector machines, SVM), через обчислювальну витратність штучних нейронних мереж (ШНМ) та брак розуміння того, як мозок сплітає свої біологічні мережі.

Як неглибоке, так і глибоке навчання (наприклад, рекурентні мережі) ШНМ для розпізнавання мовлення досліджували протягом багатьох років.[89][90][91] Ці методи ніколи не перевершували технологію неоднорідних внутрішньо-ручних гауссових сумішевих моделей[en]/прихованих марковських моделей (ГСМ-ПММ, англ. GMM-HMM) на основі породжувальних моделей мовлення, тренованих розрізнювально.[92] Було проаналізовано основні труднощі, включно зі зниканням градієнта[79] й слабкою структурою часової кореляції в нейронних передбачувальних моделях.[93][94] Додатковими труднощами були брак тренувальних даних та обмежена обчислювальна потужність. Більшість дослідників розпізнавання мовлення відійшли від нейронних мереж, щоби займатися породжувальним моделюванням. Винятком був SRI International наприкінці 1990-х років. Фінансований агенціями уряду США АНБ та DARPA, SRI вивчав глибокі нейронні мережі в розпізнаванні мовлення та мовця. Команда розпізнавання мовців на чолі з Ларрі Геком[en] повідомила про значний успіх із глибокими нейронними мережами в обробці мовлення на оцінюванні розпізнавання мовців Національного інституту стандартів і технологій 1998 року.[95] Потім глибоку нейронну мережу SRI було розгорнуто в Nuance Verifier, що стало першим великим промисловим застосуванням глибокого навчання.[96] Принцип піднесення «сирих» ознак над ручною оптимізацією було вперше успішно досліджено в архітектурі глибокого автокодувальника на «сирій» спектрограмі або ознаках лінійного блока фільтрів[en] наприкінці 1990-х,[96] що показало його перевагу над мел-кепстровими ознаками, які містять етапи незмінного перетворення зі спектрограм. Сирі ознаки мовлення, хвилеформи, згодом дали чудові великомасштабні результати.[97]

Розпізнавання мовлення перейняла ДКЧП. 2003 року ДКЧП на певних завданнях почала конкурувати з традиційними розпізнавачами мовлення.[98] 2006 року Алекс Ґрейвс[en], Сантьяго Фернандес, Фаустіно Ґомес та Шмідхубер поєднали її з нейромережною часовою класифікацією[en] (НЧК, англ. connectionist temporal classification, CTC)[99] у стеках РНМ ДКЧП.[100] 2015 року в розпізнаванні мовлення Google, як було повідомлено, стався різкий 49-відсотковий стрибок продуктивності завдяки НЧК-тренованій ДКЧП, яку вони зробили доступною через голосовий пошук Google.[101]

Вплив глибокого навчання в промисловості почався на початку 2000-х років, коли, за словами Яна ЛеКуна, ЗНМ вже обробляли приблизно від 10 % до 20 % усіх чеків, виписуваних у США.[102] Промислові застосування глибокого навчання для широкомасштабного розпізнавання мовлення почалися приблизно 2010 року.

2006 року публікації Джеффа Гінтона, Руслана Салахутдінова[en], Осіндеро та Тее[en][103][104][105] показали, як багатошарову нейронну мережу прямого поширення можливо ефективно попередньо тренувати шар за шаром, розглядаючи кожен шар по черзі як некеровану обмежену машину Больцмана, а потім тонко налаштовувати її за допомогою керованого зворотного поширення.[106] Ці праці стосувалися навчання для глибоких мереж переконань.

Мотивом семінару NIPS 2009 року з глибокого навчання для розпізнавання мовлення були обмеження глибоких породжувальних моделей мовлення та можливість того, що завдяки потужнішому апаратному забезпеченню та великомасштабним наборам даних глибокі нейронні мережі (ГНМ, англ. deep neural nets, DNN) можуть стати практичними. Вважалося, що попереднє тренування ГНМ за допомогою породжувальних моделей глибоких мереж переконань (ГМП, англ. deep belief nets, DBN) дозволить подолати основні труднощі нейронних мереж. Проте було виявлено, що заміна попереднього тренування великими обсягами тренувальних даних для безпосереднього зворотного поширення при використанні ГНМ з великими контекстнозалежними шарами виходу призводить до різко нижчих рівнів похибок, ніж у гауссової сумішевої моделі (ГСМ)/прихованої марковської моделі (ПММ), що була на рівні останніх досягнень на той час, а також ніж у передовіших систем на основі породжувальних моделей.[107] Природа похибок розпізнавання, породжуваних цими двома типами систем, характерно відрізнялася,[108] пропонуючи технічні прояснення щодо того, як інтегрувати глибоке навчання в наявну високоефективну систему декодування мовлення в реальному часі, розгорнуту всіма основними системами розпізнавання мовлення.[12][109][110] Аналіз близько 2009—2010 років, порівнюючи ГСМ (та інші породжувальні моделі мовлення) з моделями ГНМ, стимулював перші промислові інвестиції в глибоке навчання для розпізнавання мовлення.[108] Цей аналіз було зроблено з порівнянною продуктивністю (менше 1,5 % у рівні похибок) між розрізнювальними ГНМ та породжувальними моделями.[107][108][111] 2010 року дослідники розширили глибоке навчання від TIMIT[en] до великословникового розпізнавання мовлення, застосувавши великі шари виходу ГНМ на основі контекстнозалежних станів ПММ, побудованих за допомогою дерев рішень.[112][113][114][109]

Глибоке навчання є частиною систем рівня останніх досягнень у різних дисциплінах, зокрема в комп'ютернім баченні та автоматичному розпізнаванні мовлення (АРМ, англ. automatic speech recognition, ASR). Результати на загальновживаних оцінювальних наборах, таких як TIMIT[en] (АРМ) та MNIST (класифікування зображень), а також низці завдань великословникового розпізнавання мовлення, постійно покращувалися.[107][115] Згорткові нейронні мережі (ЗНМ) для АРМ було витіснено НЧК[99] для ДКЧП,[81][101][116][117][118] але в комп'ютернім баченні вони успішніші.

Удосконалення апаратного забезпечення відновило інтерес до глибокого навчання. 2009 року Nvidia брала участь у так званому «великому вибуху» глибокого навчання, «оскільки нейронні мережі глибокого навчання тренували за допомогою графічних процесорів (ГП) Nvidia».[119] Того року Ендрю Ин визначив, що ГП можуть підвищити швидкість систем глибокого навчання приблизно в 100 разів.[120] Зокрема, ГП добре підходять для матричних/векторних обчислень, задіяних у машинному навчанні.[121][122][123] ГП прискорюють алгоритми тренування на порядки, скорочуючи час роботи з тижнів до днів.[124][125] Крім того, для ефективної обробки моделей глибокого навчання можливо використовувати спеціалізоване обладнання та оптимізацію алгоритмів.[126]

Наприкінці 2000-х глибоке навчання почало перевершувати інші методи в змаганнях з машинного навчання. 2009 року довга короткочасна пам'ять, натренована нейромережною часовою класифікацією[en] (Алекс Ґрейвс[en], Сантьяго Фернандес, Фаустіно Ґомес та Юрген Шмідхубер, 2006)[99] стала першою РНМ, яка виграла конкурси з розпізнавання образів, вигравши три змагання з розпізнавання неперервного рукописного тексту.[127][17] Пізніше Google використала натреновану НЧК ДКЧП для розпізнавання мовлення на смартфоні.[128][101]

Значний вплив на розпізнавання зображень або об'єктів відчувався з 2011 по 2012 роки. Хоча ЗНМ, треновані зворотним поширенням, існували десятиліттями,[57][59] а втілення НМ на ГП — роками,[121] включно із ЗНМ,[123][17] для прогресу в комп'ютернім баченні знадобилися швидші втілення ЗНМ на графічних процесорах. 2011 року DanNet[129][6] Дена Чирешана, Улі Меєра, Джонатана Маскі, Луки Марії Гамбардели[en] та Юргена Шмідхубера вперше досягла надлюдських результатів у змаганні з розпізнавання візуальних образів, перевершивши традиційні методи втричі.[17] Також 2011 року DanNet виграла конкурс із китайського рукописного тексту ICDAR, а в травні 2012 року перемогла в конкурсі з сегментування зображень ISBI.[130] До 2011 року ЗНМ не відігравали великої ролі на конференціях з комп'ютерного бачення, але в червні 2012 року публікація Чирешана зі співавт. на провідній конференції CVPR[6] показала, як максимізувально агрегувальні ЗНМ на ГП можуть значно покращувати багато еталонних рекордів у баченні. У вересні 2012 року DanNet також виграла конкурс ICPR з аналізу великих медичних зображень для виявляння раку, а наступного року також і MICCAI Grand Challenge на ту ж тему.[131] У жовтні 2012 року подібна AlexNet Олексія Крижевського, Іллі Суцкевера та Джефрі Гінтона[7] виграла великомасштабне змагання ImageNet[en] зі значним відривом від неглибоких методів машинного навчання. Мережа VGG-16 Карена Симоняна[en] та Ендрю Зіссермана[en][132] ще більше знизила рівень похибок і виграла конкурс ImageNet 2014, слідуючи подібній тенденції у широкомасштабному розпізнаванні мовлення.

Потім класифікування зображень було розширено до складнішого завдання породжування описів[en] (підписів) для зображень, часто як поєднання ЗНМ та ДКЧП.[133][134][135]

2012 року команда під проводом Джорджа Даля виграла конкурс «Merck Molecular Activity Challenge», використовуючи багатозадачні глибокі нейронні мережі для передбачування біомолекулярної мішені[en] одного препарату.[136][137] 2014 року група Зеппа Хохрайтера[en] використала глибоке навчання для виявляння нецільових і токсичних впливів хімічних речовин навколишнього середовища у поживних речовинах, побутових товарах і ліках, і виграла «Tox21 Data Challenge» NIH, FDA та NCATS[en].[138][139][140]

2016 року Роджер Парлофф зазначив «революцію глибокого навчання», яка змінила галузь ШІ.[141]

У березні 2019 року Йошуа Бенжіо[en], Джефрі Гінтона та Яна ЛеКуна було нагороджено премією Тюрінга за концептуальні та інженерні прориви, які зробили глибокі нейронні мережі критично важливою складовою обчислювальної техніки.

В реальності текстури та контури не буде подано поодинокими вузлами, а радше пов'язаними ваговими шаблонами декількох вузлів.

Шту́чні нейро́нні мере́жі (ШНМ, англ. artificial neural networks, ANN) або коннекціоні́стські систе́ми (англ. connectionist systems) — це обчислювальні системи, натхненні біологічними нейронними мережами, які складають мозок тварин. Такі системи вчаться (поступово вдосконалюють свої здібності) виконувати завдання, розглядаючи приклади, як правило, без програмування під конкретне завдання. Наприклад, у розпізнаванні зображень вони можуть навчитися встановлювати зображення, які містять котів, аналізуючи приклади зображень, мічені[en] вручну як «кіт» чи «кота нема», і використовуючи результати цього аналізу для встановлювання котів на інших зображеннях. Вони знайшли найбільше використання в застосуваннях, які важко висловити за допомогою традиційного комп'ютерного алгоритму з використанням програмування на основі правил .

ШНМ ґрунтується на сукупності з'єднаних вузлів, званих штучними нейронами (аналогічно біологічним нейронам у біологічному мозку). Кожне з'єднання (синапс) між нейронами може передавати сигнал іншому нейронові. Приймальний (постсинаптичний) нейрон може обробляти сигнал(и), а потім сигналізувати подальшим нейронам. Нейрони можуть мати стан, як правило, поданий дійсними числами, зазвичай між 0 та 1. Нейрони та синапси також можуть мати вагу, яка змінюється в міру навчання, що може збільшувати або зменшувати силу сигналу, який вони надсилають далі.

Як правило, нейрони впорядковано в шари (англ. layers). Різні шари можуть виконувати різні типи перетворень над своїми входами. Сигнали проходять від першого шару (шару входу) до останнього шару (шару виходу), можливо, після проходження шарами декілька разів.

Початкова мета нейромережного підходу полягала у розв'язуванні задач таким же чином, як це робив би людський мозок. З часом увага зосередилася на відповідності конкретним розумовим здібностям, що призвело до відхилень від біології, таких як зворотне поширення, або передавання інформації у зворотному напрямку з підлаштовуванням мережі відображувати цю інформацію.

Нейронні мережі використовували для різноманітних завдань, включно з комп'ютерним баченням, розпізнаванням мовлення, машинним перекладом, фільтруванням соціальних мереж, грою в настільні та відеоігри[en] та медичною діагностикою.

Станом на 2017 рік нейронні мережі зазвичай мають від кількох тисяч до кількох мільйонів вузлів та мільйони з'єднань. Незважаючи на те, що це число на кілька порядків менше за число нейронів у мозку людини, ці мережі можуть виконувати багато завдань на рівні, що перевершує людський (наприклад, розпізнавати обличчя або грати в «Ґо»[143]).

Глибока нейронна мережа (ГНМ, англ. deep neural network, DNN) — це штучна нейронна мережа (ШНМ) із кількома шарами між шарами входу та виходу.[14][17] Існують різні типи нейронних мереж, але вони завжди складаються з тих же складових: нейронів, синапсів, ваг, зміщень та функцій.[144] Ці складові в цілому функціонують у спосіб, що імітує функціювання людського мозку, і їх, як і будь-який інший алгоритм МН, можливо тренувати.[джерело?]

Наприклад, ГНМ, тренована розпізнавати породи собак, проходитиме заданим зображенням й обчислюватиме ймовірність того, що зображений собака належить до певної породи. Користувач може переглядати результати й обирати, які ймовірності мережа повинна відображувати (вище певного порогу тощо) й повертати запропоновану мітку. Кожну математичну маніпуляцію як таку вважають шаром,[джерело?] і складні ГНМ мають багато шарів, звідси й назва «глибокі» мережі.

ГНМ можуть моделювати складні нелінійні зв'язки. Архітектури ГНМ породжують композиційні моделі, де об'єкт виражають багатошаровою композицією примітивів.[145] Додаткові шари дозволяють комбінувати ознаки з нижчих шарів, потенційно моделюючи складні дані меншою кількістю вузлів, ніж неглибокі мережі з подібною продуктивністю.[14] Наприклад, було доведено, що розріджені багатовимірні многочлени експоненційно легше наближувати за допомогою ГНМ, ніж за допомогою неглибоких мереж.[146]

До глибоких архітектур належать багато варіантів кількох основних підходів. Кожна архітектура досягла успіху в певних областях. Не завжди можливо порівняти продуктивність кількох архітектур, якщо їх оцінювали не на однакових наборах даних.

ГНМ, як правило, є мережами прямого прямого поширення, в яких дані проходять з шару входу до шару виходу без повернення назад. Спочатку ГНМ створює карту віртуальних нейронів і призначує зв'язкам між ними випадкові числові значення, або «ваги». Ваги та входи перемножуються й повертають результат між 0 та 1. Якщо мережа не розпізнає певний образ точно, алгоритм підлаштовує ці ваги.[147] Таким чином алгоритм може робити певні параметри впливовішими, доки не визначить правильну математичну операцію для повної обробки даних.

Рекурентні нейронні мережі (РНМ, англ. recurrent neural networks, RNN), в яких дані можуть простувати в будь-якому напрямку, використовують для таких застосувань як моделювання мови.[148][149][150][151][152] Для цього використання особливо ефективна довга короткочасна пам'ять.[81][153]

Згорткові глибокі нейронні мережі (ЗНМ, англ. convolutional deep neural networks, CNN) використовують у комп'ютернім баченні.[154] ЗНМ також застосовували до акустичного моделювання[en] для автоматичного розпізнавання мовлення (АРМ, англ. automatic speech recognition, ASR).[155]

Як і з ШНМ, при наївному тренуванні ГНМ може виникати багато проблем. Двома поширеними проблемами є перенавчання та обчислювальний час.

ГНМ схильні до перенавчання через додані шари абстрагування, які дозволяють їм моделювати рідкісні залежності в тренувальних даних. Для боротьби з перенавчанням під час тренування можливо застосовувати методи регуляризації, такі як обрізання вузлів (англ. unit pruning) Івахненка,[41] ослаблення ваг[en] (англ. weight decay, -регуляризація) та розрідженість (англ. sparsity, -регуляризація).[156] Альтернативна регуляризація виключенням (англ. dropout) випадковим чином вилучає вузли з прихованих шарів під час тренування. Це допомагає виключати рідкісні залежності.[157] Нарешті, дані можливо доповнювати за допомогою таких методів як обрізання та обертання, щоби менші тренувальні набори можливо було збільшити в розмірі задля зменшення ймовірності перенавчання.[158]

ГНМ повинні враховувати багато параметрів тренування, таких як розмір (кількість шарів і кількість вузлів на шар), темп навчання та первинні ваги. Прочісування простору параметрів для отримання оптимальних значень може бути недосяжним через часові та обчислювальні витрати. Обчислення прискорюють різні трюки, такі як пакетування (англ. batching, обчислення градієнта на кількох тренувальних прикладах одночасно, замість обчислення на окремих).[159] Великі оброблювальні можливості багатоядерних архітектур (таких як графічні процесори та Intel Xeon Phi) призвели до значного прискорення тренування через придатність таких оброблювальних архітектур для матричних та векторних обчислень.[160][161]

Крім того, інженери можуть шукати інші типи нейронних мереж із простішими та збіжнішими алгоритмами тренування. Одним із таких видів нейронних мереж є АКММ (артикуляційний контролер мозочкової моделі[en], англ. cerebellar model articulation controller, CMAC). Він не потребує темпів навчання та увипадковлених первинних ваг. Може бути гарантовано збіжність його процесу тренування за один крок із новим пакетом даних, а обчислювальна складність алгоритму тренування лінійна щодо кількості задіяних нейронів.[162][163]

З 2010-х років прогрес як в алгоритмах машинного навчання, так і в комп'ютерному апаратному забезпеченні призвів до ефективніших методів тренування глибоких нейронних мереж, які містять багато шарів нелінійних прихованих вузлів і дуже великий шар виходу.[164] До 2019 року графічні процесори (ГП), часто зі спеціальними вдосконаленнями для ШІ, витіснили ЦП як переважний метод тренування великомасштабного комерційного хмарного ШІ.[165] OpenAI оцінила апаратні обчислення, які використовували в найбільших проєктах глибокого навчання від AlexNet (2012) і до AlphaZero (2017), і виявила 300 000-кратне збільшення необхідного обсягу обчислень із тенденцією подвоєння часу кожні 3,4 місяці.[166][167]

Для прискорення алгоритмів глибокого навчання було розроблено спеціальні електронні схеми, звані процесорами глибокого навчання. До процесорів глибокого навчання належать нейронні процесори (НП, англ. neural processing units, NPU) у мобільних телефонах Huawei[168] та серверах хмарних обчислень, такі як тензорні процесори (ТП, англ. tensor processing units, TPU) у Google Cloud Platform.[169] Cerebras Systems[en] також створила спеціальну систему для обробки великих моделей глибокого навчання, CS-2, що ґрунтується на найбільшому процесорі в галузі, другому поколінні Wafer Scale Engine (WSE-2).[170][171]

Атомарно тонкі напівпровідники вважають перспективними для енергоефективного апаратного забезпечення глибокого навчання, де одну й ту ж базову структуру пристрою використовують як для логічних операцій, так і для зберігання даних. 2020 року Марега зі співавт. опублікували експерименти з активноканальним матеріалом великої площі для розробки пристроїв і схем з логічною пам'яттю на основі польових транзисторів з плавни́м затвором (англ. floating-gate field-effect transistors, FGFET).[172]

2021 року Й. Фельдманн зі співавт. запропонували інтегрований фотонний апаратний прискорювач для паралельної згорткової обробки.[173] Автори виділяють дві ключові переваги інтегрованої фотоніки над її електронними аналогами: (1) масивна паралельна передача даних через мультиплексування за довжиною хвилі в поєднанні з частотними гребінцями та (2) надзвичайно висока швидкість модуляції даних.[173] Їхня система може виконувати трильйони операцій множення-додавання за секунду, що вказує на потенціал інтегрованої фотоніки у застосуваннях штучного інтелекту, які потребують великих даних.[173]

Великомасштабне автоматичне розпізнавання мовлення — це перший і найпереконливіший успішний приклад глибокого навчання. РНМ ДКЧП можуть навчатися завдань «дуже глибокого навчання»,[17] до яких належать багатосекундні інтервали, що містять мовленнєві події, розділені тисячами дискретних часових кроків, де один часовий крок відповідає приблизно 10 мс. ДКЧП із забувальними вентилями[153] на певних завданнях конкурентоспроможні з традиційними розпізнавачами мовлення.[98]

Початковий успіх у розпізнаванні мовлення ґрунтувався на невеликих завданнях розпізнавання на основі TIMIT[en]. Цей набір даних містить 630 носіїв восьми основних діалектів американської англійської, де кожен читає 10 речень.[174] Його невеликий розмір дозволяє випробувати багато конфігурацій. Що ще важливіше, завдання TIMIT стосується розпізнавання фональних[en] послідовностей, яке, на відміну від розпізнавання послідовності слів, дозволяє використовувати слабкі фонобіграмні мовні моделі. Це дозволяє легше аналізувати силу аспектів акустичного моделювання розпізнавання мовлення. Частоту похибки, наведену нижче, включно з цими ранніми результатами, виміряну у відсотках рівнів фональних похибок (РФП, англ. phone error rates, PER), було узагальнено з 1991 року.

| Метод | Відсоток рівня фональної похибки (РФП) (%) |

|---|---|

| РНМ з випадковими початковими значеннями[175] | 26,1 |

| Баєсова трифональна ГСМ[en]-ПММ | 25,6 |

| Модель прихованої траєкторії (породжувальна) | 24,8 |

| Монофональна ГНМ з випадковими початковими значеннями | 23,4 |

| Монофональна ГМП-ГНМ | 22,4 |

| Трифональна ГСМ[en]-ПММ з навчанням ПМВІ | 21,7 |

| Монофональна ГМП-ГНМ на блоці фільтрів[en] | 20,7 |

| Згорткова ГНМ[176] | 20,0 |

| Згорткова ГНМ з різнорідним агрегуванням | 18,7 |

| Ансамблева ГНМ/ЗНМ/РНМ[177] | 18,3 |

| Двоспрямована ДКЧП | 17,8 |

| Ієрархічна згорткова глибока максимумовиходова мережа[178] | 16,5 |

Дебют ГНМ для розпізнавання мовців наприкінці 1990-х та розпізнавання мовлення приблизно в 2009—2011 роках, а також ДКЧП приблизно в 2003—2007 роках прискорили прогрес у восьми основних областях:[12][111][109]

- Масштабування вгору/назовні та прискорення тренування та декодування ГНМ

- Послідовнісно розрізнювальне тренування

- Обробка ознак глибокими моделями з цілісним розумінням механізмів, що лежать в їхній основі

- Пристосування ГНМ та споріднених глибоких моделей

- Багатозадачне[en] та передавальне навчання за допомогою ГНМ і споріднених глибоких моделей

- ЗНМ та як їх проєктувати, щоби найкращим чином використати предметні знання щодо мовлення

- РНМ та їхні численні варіанти з ДКЧП

- Інші типи глибоких моделей, включно з моделями на основі тензорів та комбінованими породжувально/розрізнювальними моделями.

Усі основні комерційні системи розпізнавання мовлення (наприклад, Microsoft Cortana, Xbox, Перекладач Skype[en], Amazon Alexa, Google Now, Apple Siri, Baidu та голосовий пошук iFlytek[en], а також низка мовленнєвих продуктів Nuance[en] тощо) ґрунтуються на глибокому навчанні.[12][179][180]

Поширеним оцінковим набором для класифікування зображень є набір даних бази даних MNIST. Він складається з рукописних цифр і містить 60 000 навчальних та 10 000 випробувальних прикладів. Як і у випадку з TIMIT, його невеликий розмір дозволяє користувачам випробувати кілька конфігурацій. Доступний вичерпний перелік результатів на цьому наборі.[181]

Розпізнавання зображень на основі глибокого навчання стало «надлюдським», даючи точніші результати, ніж люди, учасники змагання. Вперше це сталося 2011 року з розпізнаванням дорожніх знаків, а 2014 року з розпізнаванням облич людей.[182][183]

Треновані глибоким навчанням транспортні засоби тепер інтерпретують камери кругового огляду.[184] Іншим прикладом є новітній аналіз у лицевій дисморфології (англ. Facial Dysmorphology Novel Analysis, FDNA), який використовують для аналізу випадків вад розвитку людини, пов'язаних із великою базою даних генетичних синдромів.

З прогресом, досягнутим у розпізнаванні зображень, тісно пов'язане все ширше застосування методик глибокого навчання до різноманітних завдань образотворчого мистецтва. ГНМ довели свою здатність, наприклад, у

- встановлюванні періоду стилю заданої картини[185][186]

- Нейроннім перенесенні стилю[en] — вловлюванні стилю певного твору мистецтва та застосуванні його візуально приємним чином до довільної фотографії чи відео[185][186]

- створенні вражаючих зображень на основі випадкових вхідних зорових полів.[185][186]

Нейронні мережі використовують для втілення мовних моделей з початку 2000-х років.[148] ДКЧП допомогла покращити машинний переклад і моделювання мови.[149][150][151]

Іншими ключовими методиками в цій галузі є негативне вибирання (англ. negative sampling)[187] та вкладання слів. Вкладання слів, наприклад word2vec, можливо розглядати як шар подання в архітектурі глибокого навчання, який перетворює атомарне слово в подання розташування слова відносно інших слів у наборі даних; розташування подається як точка у векторному просторі. Використання вкладення слів як вхідного рівня РНМ дозволяє цій мережі аналізувати речення та фрази за допомогою ефективної композиційної векторної граматики. Композиційну векторну граматику можливо розглядати як імовірнісну контекстновільну граматику[en] (ІКВГ, англ. probabilistic context free grammar, PCFG), втілену РНМ.[188] Рекурсивні автокодувальники, збудовані поверх вкладень слів, можуть оцінювати схожість речень та виявляти перефразування.[188] Глибокі нейронні архітектури забезпечують найкращі результати для аналізу складників,[189] тональності,[190] пошуку інформації,[191][192] розуміння розмовної мови,[193] машинного перекладу,[149][194] контекстного зв'язування об'єктів,[194] розпізнавання стилю написання,[195] розпізнавання іменованих сутностей (класифікування лексем),[196] класифікування тексту та інших.[197]

Останні розробки узагальнюють вкладання слів до вкладання речень.

Перекладач Google використовує велику наскрізну мережу довгої короткочасної пам'яті (ДКЧП).[198][199][200][201] Нейронний машинний переклад Google використовує метод машинного перекладу на основі прикладів, у якому система «вчиться на мільйонах прикладів».[199] Він перекладає «цілі речення за раз, а не частини». Перекладач Google підтримує понад сто мов.[199] Мережа кодує «семантику речення, а не просто запам'ятовує пофразові переклади».[199][202] Перекладач Google використовує англійську як проміжну між більшістю мовних пар.[202]

Значний відсоток ліків-кандидатів не отримує схвалення регуляторних органів. Ці невдачі спричинені недостатньою ефективністю (впливом на мішень), небажаними взаємодіями (впливами поза мішенню) або непередбаченими токсичними впливами.[203][204] Дослідники вивчали використання глибокого навчання для передбачування біомолекулярних мішеней[en],[136][137] антимішеней[en] та токсичних впливів хімічних речовин навколишнього середовища у поживних речовинах, побутових товарах і ліках.[138][139][140]

AtomNet — це система глибокого навчання для раціонального конструювання ліків на основі структури.[205] AtomNet використовували для передбачування новітніх біомолекул-кандидатів для мішеней таких захворювань як вірус Ебола[206] та розсіяний склероз.[207][206]

2017 року графові нейронні мережі[en] було вперше використано для передбачування різних властивостей молекул у великому наборі токсикологічних даних.[208] 2019 року породжувальні нейронні мережі було використано для створення молекул, які було перевірено експериментально від початку до кінця на мишах.[209][210]

Глибоке навчання з підкріпленням[en] використовували для наближування цінності можливих дій прямого маркетингу, визначених у термінах змінних RFM. Було показано, що ця функція оцінки цінності має природну інтерпретацію як пожиттєва цінність клієнта.[211]

Рекомендаційні системи використовували глибоке навчання для виділяння значущих ознак для моделі латентних чинників для музичних та журнальних рекомендацій на основі вмісту.[212][213] Для навчання уподобань користувачів із кількох областей було застосовано багатоаспектне глибоке навчання (англ. multi-view deep learning).[214] Ця модель використовує гібридний спільний та оснований на вмісті підхід, і покращує рекомендації в декількох завданнях.

Автокодувальну ШНМ використовували в біоінформатиці для передбачування анотацій генної онтології та зв'язків між генами й функціями.[215]

У медичній інформатиці глибоке навчання використовували для передбачування якості сну на основі даних з носимих пристроїв[216] та для передбачування ускладнень здоров'я з даних електронних медичних записів.[217]

Глибокі нейронні мережі (ГНМ) можливо використовувати для оцінювання ентропії стохастичних процесів, їх називають нейронними оцінювачами спільної ентропії (НОСЕ, англ. Neural Joint Entropy Estimator, NJEE).[218] Таке оцінювання дає уявлення про вплив випадкових змінних входу на незалежну випадкову змінну. На практиці, ГНМ тренують як класифікатор, який відображує вектор або матрицю входу X у розподіл імовірності виходу над можливими класами випадкової змінної Y за заданого входу X. Наприклад, у завданнях класифікування зображень НОСЕ відображує вектор значень кольорів пікселів у ймовірності над можливими класами зображень. На практиці розподіл імовірності Y отримують за допомогою шару Softmax із кількістю вузлів, яка дорівнює розміру абетки Y. НОСЕ використовує неперервно диференційовні передавальні функції, так що умови теореми про універсальне наближення виконуються. Показано, що цей метод забезпечує сильно слушну оцінку й перевершує інші методи в разі великих розмірів абетки.[218]

Було показано, що глибоке навчання дає конкурентоспроможні результати в медичних застосуваннях, таких як класифікування ракових клітин, виявляння уражень, сегментування органів та покращування зображень.[219][220] Сучасні інструменти глибокого навчання демонструють високу точність виявляння різних захворювань та доцільність використання їх фахівцями для підвищення ефективності діагностування.[221][222]

Знайти відповідну мобільну аудиторію для мобільної реклами завжди складно, оскільки необхідно розглянути та проаналізувати багато точок даних, перш ніж стане можливо створити цільовий сегмент і використати його для розміщення реклами на будь-якому рекламному сервері.[223] Глибоке навчання використовували для інтерпретування великих, багатовимірних наборів рекламних даних. Під час циклу інтернет-реклами запит/подача/натискання збирають багато точок даних. Ця інформація може ставати основою машинного навчання для покращення обирання оголошень.

Глибоке навчання було успішно застосовано до обернених задач[en], таких як знешумлювання, надвисока роздільність[en], заповнювання прогалин[en] та кольоризування фільмів.[224] До цих застосувань входять такі методи навчання як «Shrinkage Fields for Effective Image Restoration»,[225] який тренується на наборі зображень, та глибоке апріорне зображень[en] (англ. Deep Image Prior), що тренується на зображенні, якому потрібне відновлення.

Глибоке навчання успішно застосовують для виявляння фінансового шахрайства, ухилення від сплати податків[226] та боротьби з відмиванням грошей.[227]

У листопаді 2023 року дослідники з Google DeepMind та Національної лабораторії ім. Лоуренса в Берклі оголосили, що вони розробили систему ШІ, відому як GNoME. Ця система зробила внесла внесок до матеріалознавства, відкривши понад 2 мільйони нових матеріалів за відносно короткий час. GNoME використовує методики глибокого навчання для ефективного дослідження потенційних структур матеріалів, досягаючи значного зростання у встановлюванні стабільних неорганічних кристалічних структур. Передбачення цієї системи були підтверджені за допомогою автономних роботизованих експериментів, продемонструвавши вражаючий рівень успішності в 71 %. Дані про нововідкриті матеріали доступні публічно через базу даних Materials Project[en], надаючи дослідникам можливість встановлювати матеріали з бажаними властивостями для різних застосувань. Цей розвиток має наслідки для майбутнього наукових відкриттів та інтегрування ШІ в дослідження матеріалознавства, потенційно прискорюючи нововведення в матеріалах та знижуючи вартість розробки продуктів. Використання ШІ та глибокого навчання натякає на можливість мінімізації або виключення ручних лабораторних експериментів та дозволяє науковцям більше зосередитися на проєктуванні й аналізі унікальних сполук.[228][229][230]

Міністерство оборони Сполучених Штатів застосовувало глибоке навчання, щоб тренувати роботів виконувати нові завдання через спостереження.[231]

Фізичні нейронні мережі (англ. physics informed neural networks) використовували для розв'язування диференціальних рівнянь із частинними похідними як у прямих, так і в обернених задачах на основі даних.[232] Одним із прикладів є відбудова потоку рідини, керована рівняннями Нав'є — Стокса. Використання фізичних нейронних мереж не потребує часто витратного породжування сітки, на яке спираються звичайні методи обчислювальної гідродинаміки.[233][234]

Відбудова зображень (англ. image reconstruction) — це відбудова зображень, що лежать в основі пов'язаних із зображеннями вимірювань. Декілька праць показали кращу та відмінну продуктивність методів глибокого навчання порівняно з аналітичними методами для різних застосувань, наприклад, спектральних[235] та ультразвукових зображень.[236]

Епігенетичний годинник (англ. epigenetic clock) — це біохімічний тест, який можливо використовувати для вимірювання віку. Галкін зі співавт. використали глибокі нейронні мережі, щоби натренувати епігенетичний годинник старіння з безпрецедентною точністю, використавши понад 6000 зразків крові.[237] Цей годинник використовує інформацію з 1000 CpG-острівців і передбачує людей з певними станами старше здорових контрольних груп: ЗЗК[en], лобово-скроневою деменцією, раком яєчника, ожирінням. Цей годинник старіння планувала випустити для загального використання в 2021 року дочірня компанія компанії Insilico Medicine[en], Deep Longevity.

Глибоке навчання тісно пов'язане з класом теорій розвитку мозку[en] (особливо нової кори), запропонованих когнітивними нейробіологами на початку 1990-х років.[238][239][240][241] Ці теорії розвитку було втілено в обчислювальних моделях, що зробило їх попередниками систем глибокого навчання. Ці моделі розвитку поділяють таку властивість, що різні запропоновані динаміки навчання в мозку (наприклад, хвиля чинника росту нервів) підтримують самоорганізацію, дещо аналогічну нейронним мережам, які використовують у моделях глибокого навчання. Як і нова кора, нейронні мережі використовують ієрархію багатошарових фільтрів, у яких кожен шар розглядає інформацію з попереднього шару (або робочого середовища), а потім передає свій вихід (і, можливо, початковий вхід) іншим шарам. Цей процес видає самоорганізований стос вимірювальних перетворювачів, добре підлаштованих до їхнього робочого середовища. В описі 1995 року зазначено: «…мозок немовляти, здається, організовується під впливом хвиль так званих чинників росту… різні ділянки мозку стають з'єднаними послідовно, причому один шар тканини дозріває раніше іншого, і так далі, поки не дозріє весь мозок».[242]

Було використано різноманітні підходи для дослідження правдоподібності моделей глибокого навчання з нейробіологічної точки зору. З одного боку, було запропоновано декілька варіантів алгоритму зворотного поширення з метою підвищення реалістичності його обробки.[243][244] Інші дослідники стверджують, що до біологічної дійсності можуть бути ближчими форми некерованого глибокого навчання, такі як ті, що ґрунтуються на ієрархічних породжувальних моделях та глибоких мережах переконань.[245][246] У цьому відношенні моделі породжувальних нейронних мереж пов'язували з нейробіологічними свідченнями обробки в корі головного мозку на основі вибірки.[247]

Хоча систематичного порівняння між організацією людського мозку та нейронним кодуванням у глибоких мережах створено ще не було, було повідомлено про кілька аналогій. Наприклад, обчислення, які виконуються блоками глибокого навчання, можуть бути подібними до обчислень справжніх нейронів[248] і нейронних популяцій.[249] Подібним чином, подання, вироблені моделями глибокого навчання, подібні до тих, які вимірюють у зоровій системі приматів[250] як на рівні окремого вузла[251], так і на рівні популяції.[252]

Лабораторія ШІ Facebook виконує такі завдання як автоматичне мічення завантажених зображень[en] іменами людей на них.[253]

Google DeepMind Technologies розробила систему, здатну навчитися грати у відеоігри Atari, використовуючи як дані входу лише пікселі. 2015 року вони продемонстрували свою систему AlphaGo, яка навчилася грі Ґо настільки добре, що перемогла професійного гравця.[254][255][256] Перекладач Google використовує нейронну мережу, щоби перекладати між понад 100 мовами.

2017 року було запущено Covariant.ai, зосереджений на інтегруванні глибокого навчання на заводах.[257]

Станом на 2008 рік[258] дослідники Техаського університету в Остіні (UT) розробили систему машинного навчання під назвою Training an Agent Manually via Evaluative Reinforcement (укр. ручне тренування агента через оцінювальне підкріплення), або TAMER, яка запропонувала нові методи для роботів та комп'ютерних програм, як вчитися виконувати завдання шляхом взаємодії з людиною-інструктором.[231] Спершу розроблений як TAMER, новий алгоритм під назвою Deep TAMER було пізніше представлено 2018 року під час співпраці між Дослідницькою лабораторією армії США (ARL) та дослідниками UT. Deep TAMER використовував глибоке навчання, щоби забезпечити роботові здатність навчатися нових завдань шляхом спостерігання.[231] Використовуючи Deep TAMER, робот навчався завдання разом із тренером-людиною, переглядаючи відеопотоки або спостерігаючи, як людина виконує завдання особисто. Пізніше робот відпрацьовував завдання за допомогою тренера, який давав відгуки, такі як «добра робота» та «погана робота».[259]

Глибоке навчання притягувало як критику, так і коментарі, у деяких випадках поза межами галузі інформатики.

Основна критика стосується браку теорії навколо деяких методів.[260] Навчання в найпоширеніших глибоких архітектурах втілено за допомогою добре зрозумілого градієнтного спуску. Проте теорія навколо цих алгоритмів, таких як контрастове розходження, не така ясна[джерело?] (наприклад: Він збігається? Якщо так, то як швидко? Що він наближує?). На методи глибокого навчання часто дивляться як на чорну скриньку, роблячи більшість підтверджень емпірично, а не теоретично.[261]

Інші зазначають, що глибоке навчання слід розглядати як крок до втілення сильного ШІ, а не як всеохопне рішення. Незважаючи на потужність методів глибокого навчання, їм все ще бракує значної частини функціональності, необхідної, щоби втілити цю мету повністю. Психолог-дослідник Ґері Маркус[en] зазначив:

Насправді, глибоке навчання це лише частина більшого завдання створення розумних машин. Таким методикам бракує способів подання причинно-наслідкових зв'язків (…) вони не мають очевидних способів здійснення логічних висновків, і вони також ще далекі від поєднання абстрактних знань, таких як інформація про те, чим є об'єкти, для чого вони, і як їх зазвичай використовують. Найпотужніші системи ШІ, такі як Watson (…) використовують такі методики, як глибоке навчання, як лише один з елементів у дуже складному ансамблі методик, починаючи від статистичних методик баєсового висновування, і аж до дедуктивного міркування.[262]

Серед подальших відсилань до тієї ідеї, що художня чутливість може бути притаманна відносно низьким рівням когнітивної ієрархії, опублікована низка графічних зображень внутрішніх станів глибоких (20—30 шарів) нейронних мереж, які намагаються розгледіти серед по суті випадкових даних зображення, на яких їх було треновано,[263] демонструє візуальну привабливість: первинне повідомлення про це дослідження отримало набагато більше за 1000 коментарів і було предметом протягом деякого часу найвідвідуванішої статті на вебсайті Ґардіан.[264]

Деякі архітектури глибокого навчання демонструють проблематичну поведінку,[265] наприклад, впевнене класифікування невпізнанних зображень як належних до знайомої категорії звичайних зображень (2014)[266] та неправильне класифікування незначних збурень правильно класифікованих зображень (2013).[267] Ґьорцель припустив, що така поведінка зумовлена обмеженнями у їхніх внутрішніх поданнях, і що ці обмеження перешкоджатимуть інтегруванню до гетерогенної багатокомпонентної архітектури загального штучного інтелекту (ЗШІ).[265] Можливо, ці проблеми можна розв'язати за допомогою архітектур глибокого навчання, які внутрішньо утворюють стани, гомологічні розкладам граматики зображень[268] спостережуваних об'єктів та подій.[265] Виведення граматики[en] (візуальної чи мовної) з тренувальних даних було би рівнозначним обмеженню системи міркуваннями здорового глузду[en], які оперують поняттями в термінах граматичних породжувальних правил[en], і є основною метою як засвоєння мови людиною,[269] так і штучного інтелекту (ШІ).[270]

Коли глибоке навчання переміщується з лабораторії у світ, дослідження та досвід показують вразливість штучних нейронних мереж до хакерів та обману.[271] Визначаючи схеми, які ці системи використовують для функціювання, зловмисники можуть змінювати вхідні дані до ШНМ таким чином, що ШНМ знаходить відповідність, яку люди-спостерігачі не розпізнають. Наприклад, зловмисник може внести незначні зміни в зображення таким чином, що ШНМ знайде збіг, навіть якщо для людини зображення виглядає зовсім не схожим на ціль пошуку. Таке маніпулювання називають «змагальною атакою» (англ. "adversarial attack").[272]

2016 року дослідники скористалися однією ШНМ, щоби, підкориговуючи зображення, методом спроб і помилок визначити, на чому зосереджується інша, й таким чином створити зображення, які вводили її в оману. Для людського ока змінені зображення нічим не відрізнялися. Інша група показала, що роздруківки підроблених зображень, які потім фотографували, успішно обманювали систему класифікування зображень.[273] Одним із засобів захисту є зворотний пошук зображень, під час якого можливе підроблене зображення надсилається на сайт, наприклад TinEye, який потім може знайти інші його примірники. Одне із вдосконалень полягає у пошуку з використанням лише частин зображення, щоби встановити зображення, з яких цей фрагмент могло бути взято.[274]

Інша група показала, що певні психоделічні видовища можуть змусити систему розпізнавання облич вважати звичайних людей знаменитостями, потенційно дозволяючи одній людині видавати себе за іншу. 2017 року дослідники додали наліпки до знаків заборони проїзду без зупинки, змусивши ШНМ класифікувати їх неправильно.[273]

Проте ШНМ можливо додатково тренувати виявляти спроби обману, що потенційно веде до перегонів озброєнь між зловмисниками й захисниками, подібних до тих, які вже є основою індустрії захисту від зловмисних програм. ШНМ було навчено перемагати програмне забезпечення захисту від зловмисного програмного забезпечення на основі ШНМ шляхом повторюваних атак на захист зловмисним програмним забезпеченням, яке постійно змінювалося генетичним алгоритмом, доки воно не ошукало протизловмисне програмне забезпечення, зберігаючи свою здатність пошкоджувати ціль.[273]

2016 року інша група продемонструвала, що певні звуки можуть змусити систему голосових команд Google Now відкрити певну веб-адресу, й висунула гіпотезу, що це може «послужити сходинкою для подальших атак (наприклад, відкривання вебсторінки, на якій розміщено зловмисне програмне забезпечення)».[273]

В «отруюванні даними[en]» до тренувального набору системи машинного навчання систематично підкидають хибні дані, щоби завадити їй досягти майстерності.[273]

Більшість систем глибокого навчання покладаються на тренувальні та контрольні (англ. verification) дані, породжувані та/або розмічувані людьми.[275] У філософії засобів масової інформації стверджують, що для цієї мети регулярно використовують не лише низькооплачувану клікпрацю[en] (наприклад, на Amazon Mechanical Turk), а й неявні форми людської мікропраці[en], які часто не визнають як таку.[276] Філософ Райнер Мюльхоф[de] розрізняє п'ять типів «машинного заволодівання» людською мікропрацею для породжування тренувальних даних: (1) ігрофікація (вбудовування розмічування або обчислювальних завдань у потік гри), (2) «захоплювання та відстежування» (наприклад, CAPTCHA для розпізнавання зображень, або відстежування кліків на сторінках результатів пошуку Google), (3) використання соціальних мотивів (наприклад, позначування облич у Facebook для отримування позначених зображень обличчя), (4) розроблення інформації (наприклад, за допомогою пристроїв самооцифровування[en], таких як відстежувачі активності), та (5) клікпрацю[en].[276]

Мюльхоф стверджує, що в більшості комерційних застосувань глибокого навчання для кінцевих користувачів, таких як система розпізнавання облич Facebook[en], потреба в тренувальних даних після тренування ШНМ не зникає. Скоріше, існує постійна потреба в контрольних даних, створюваних людьми, щоби постійно калібрувати та уточнювати ШНМ. З цією метою Facebook запровадив функцію, що щойно користувачів автоматично розпізнано на зображенні, вони отримують сповіщення. Вони можуть обрати, чи хочуть вони бути публічно позначеними на цьому зображенні, чи повідомити Facebook, що на зображенні не вони.[277] Цей інтерфейс користувача є механізмом породжування «постійного потоку контрольних даних»[276] для подальшого тренування мережі в режимі реального часу. Як стверджує Мюльхоф, залучення людей-користувачів до породжування тренувальних та контрольних даних настільки типове для більшості комерційних застосувань глибокого навчання для кінцевих користувачів, що такі системи можна назвати «штучним інтелектом з участю людини» (англ. "human-aided artificial intelligence").[276]

- Застосування штучного інтелекту

- Порівняння програмного забезпечення глибокого навчання

- Стиснене сприйняття[en]

- Диференційовне програмування[en]

- Мережа з відлунням стану

- Перелік проєктів штучного інтелекту[en]

- Перелік наборів даних для досліджень машинного навчання

- Резервуарне обчислення

- Простір масштабів та глибоке навчання

- Розріджене кодування

- Стохастичний папуга[en]

- ↑ Schulz, Hannes; Behnke, Sven (1 листопада 2012). Deep Learning. KI - Künstliche Intelligenz (англ.). 26 (4): 357—363. doi:10.1007/s13218-012-0198-z. ISSN 1610-1987. S2CID 220523562.

- ↑ Хома, Ю. В.; Бенч, А. Я. (2019). Порівняльний аналіз програмно-апаратного забезпечення алгоритмів глибокого навчання (PDF). Комп'ютерні системи і мережі (укр.). 1 (1): 97—102.

- ↑ Дорош, Н. Л.; Цаплюк, О. В. (3-5 листопада 2021). Розпізнавання зображень алгоритмом глибокого навчання (PDF). VII Міжнародна науково-технічна конференція «Комп'ютерне моделювання та оптимізація складних систем» (укр.). Дніпро: УДХТУ. с. 91—92.

- ↑ Бродкевич, В. М.; Ремесло, В. Я. (2018). Алгоритми машинного навчання (МН) та глибокого навчання (ГН) і їх використання в прикладних додатках (PDF). Міжнародний науковий журнал «Інтернаука» (укр.). Київ. 1 (11 (51)): 56—60. ISSN 2520-2057.

- ↑ LeCun, Yann; Bengio, Yoshua; Hinton, Geoffrey (2015). Deep Learning. Nature (англ.). 521 (7553): 436—444. Bibcode:2015Natur.521..436L. doi:10.1038/nature14539. PMID 26017442. S2CID 3074096.

- ↑ а б в Ciresan, D.; Meier, U.; Schmidhuber, J. (2012). Multi-column deep neural networks for image classification. 2012 IEEE Conference on Computer Vision and Pattern Recognition (англ.). с. 3642—3649. arXiv:1202.2745. doi:10.1109/cvpr.2012.6248110. ISBN 978-1-4673-1228-8. S2CID 2161592.

- ↑ а б Krizhevsky, Alex; Sutskever, Ilya; Hinton, Geoffrey (2012). ImageNet Classification with Deep Convolutional Neural Networks (PDF). NIPS 2012: Neural Information Processing Systems, Lake Tahoe, Nevada (англ.). Архів (PDF) оригіналу за 10 січня 2017. Процитовано 24 травня 2017.

- ↑ Google's AlphaGo AI wins three-match series against the world's best Go player. TechCrunch (англ.). 25 травня 2017. Архів оригіналу за 17 червня 2018. Процитовано 17 червня 2018.

- ↑ Marblestone, Adam H.; Wayne, Greg; Kording, Konrad P. (2016). Toward an Integration of Deep Learning and Neuroscience. Frontiers in Computational Neuroscience (англ.). 10: 94. arXiv:1606.03813. Bibcode:2016arXiv160603813M. doi:10.3389/fncom.2016.00094. PMC 5021692. PMID 27683554. S2CID 1994856.

- ↑ Bengio, Yoshua; Lee, Dong-Hyun; Bornschein, Jorg; Mesnard, Thomas; Lin, Zhouhan (13 лютого 2015). Towards Biologically Plausible Deep Learning (англ.). arXiv:1502.04156 [cs.LG].

- ↑ Study urges caution when comparing neural networks to the brain. MIT News | Massachusetts Institute of Technology (англ.). 2 листопада 2022. Процитовано 6 грудня 2023.

- ↑ а б в г д е Deng, L.; Yu, D. (2014). Deep Learning: Methods and Applications (PDF). Foundations and Trends in Signal Processing (англ.). 7 (3–4): 1—199. doi:10.1561/2000000039. Архів (PDF) оригіналу за 14 березня 2016. Процитовано 18 жовтня 2014.

- ↑ Zhang, W. J.; Yang, G.; Ji, C.; Gupta, M. M. (2018). On Definition of Deep Learning. 2018 World Automation Congress (WAC) (англ.). с. 1—5. doi:10.23919/WAC.2018.8430387. ISBN 978-1-5323-7791-4. S2CID 51971897.

- ↑ а б в г Bengio, Yoshua (2009). Learning Deep Architectures for AI (PDF). Foundations and Trends in Machine Learning (англ.). 2 (1): 1—127. CiteSeerX 10.1.1.701.9550. doi:10.1561/2200000006. S2CID 207178999. Архів оригіналу (PDF) за 4 березня 2016. Процитовано 3 вересня 2015.

- ↑ а б в г д Bengio, Y.; Courville, A.; Vincent, P. (2013). Representation Learning: A Review and New Perspectives. IEEE Transactions on Pattern Analysis and Machine Intelligence (англ.). 35 (8): 1798—1828. arXiv:1206.5538. doi:10.1109/tpami.2013.50. PMID 23787338. S2CID 393948.

- ↑ LeCun, Yann; Bengio, Yoshua; Hinton, Geoffrey (28 травня 2015). Deep learning. Nature (англ.). 521 (7553): 436—444. Bibcode:2015Natur.521..436L. doi:10.1038/nature14539. PMID 26017442. S2CID 3074096.

- ↑ а б в г д е ж и к л Schmidhuber, J. (2015). Deep Learning in Neural Networks: An Overview. Neural Networks (англ.). 61: 85—117. arXiv:1404.7828. doi:10.1016/j.neunet.2014.09.003. PMID 25462637. S2CID 11715509.

- ↑ Shigeki, Sugiyama (12 квітня 2019). Human Behavior and Another Kind in Consciousness: Emerging Research and Opportunities: Emerging Research and Opportunities (англ.). IGI Global. ISBN 978-1-5225-8218-2.

- ↑ Bengio, Yoshua; Lamblin, Pascal; Popovici, Dan; Larochelle, Hugo (2007). Greedy layer-wise training of deep networks (PDF). Advances in neural information processing systems (англ.). с. 153—160. Архів (PDF) оригіналу за 20 жовтня 2019. Процитовано 6 жовтня 2019.

- ↑ а б Hinton, G.E. (2009). Deep belief networks. Scholarpedia (англ.). 4 (5): 5947. Bibcode:2009SchpJ...4.5947H. doi:10.4249/scholarpedia.5947.

- ↑ Sahu, Santosh Kumar; Mokhade, Anil; Bokde, Neeraj Dhanraj (січень 2023). An Overview of Machine Learning, Deep Learning, and Reinforcement Learning-Based Techniques in Quantitative Finance: Recent Progress and Challenges. Applied Sciences (англ.). 13 (3): 1956. doi:10.3390/app13031956. ISSN 2076-3417.

- ↑ а б в Cybenko (1989). Approximations by superpositions of sigmoidal functions (PDF). Mathematics of Control, Signals, and Systems[en] (англ.). 2 (4): 303—314. doi:10.1007/bf02551274. S2CID 3958369. Архів оригіналу (PDF) за 10 October 2015.

- ↑ а б в Hornik, Kurt (1991). Approximation Capabilities of Multilayer Feedforward Networks. Neural Networks (англ.). 4 (2): 251—257. doi:10.1016/0893-6080(91)90009-t. S2CID 7343126.

- ↑ а б Haykin, Simon S. (1999). Neural Networks: A Comprehensive Foundation (англ.). Prentice Hall. ISBN 978-0-13-273350-2.

- ↑ а б Hassoun, Mohamad H. (1995). Fundamentals of Artificial Neural Networks (англ.). MIT Press. с. 48. ISBN 978-0-262-08239-6.

- ↑ а б Lu, Z., Pu, H., Wang, F., Hu, Z., & Wang, L. (2017). The Expressive Power of Neural Networks: A View from the Width [Архівовано 2019-02-13 у Wayback Machine.]. Neural Information Processing Systems, 6231-6239. (англ.)

- ↑ Orhan, A. E.; Ma, W. J. (2017). Efficient probabilistic inference in generic neural networks trained with non-probabilistic feedback. Nature Communications (англ.). 8 (1): 138. Bibcode:2017NatCo...8..138O. doi:10.1038/s41467-017-00181-8. PMC 5527101. PMID 28743932.

- ↑ а б в г Murphy, Kevin P. (24 серпня 2012). Machine Learning: A Probabilistic Perspective (англ.). MIT Press. ISBN 978-0-262-01802-9.

- ↑ а б Fukushima, K. (1969). Visual feature extraction by a multilayered network of analog threshold elements. IEEE Transactions on Systems Science and Cybernetics (англ.). 5 (4): 322—333. doi:10.1109/TSSC.1969.300225.

- ↑ Sonoda, Sho; Murata, Noboru (2017). Neural network with unbounded activation functions is universal approximator. Applied and Computational Harmonic Analysis (англ.). 43 (2): 233—268. arXiv:1505.03654. doi:10.1016/j.acha.2015.12.005. S2CID 12149203.

- ↑ Bishop, Christopher M. (2006). Pattern Recognition and Machine Learning (PDF) (англ.). Springer. ISBN 978-0-387-31073-2. Архів (PDF) оригіналу за 11 січня 2017. Процитовано 6 серпня 2017.

- ↑ Brush, Stephen G. (1967). History of the Lenz-Ising Model. Reviews of Modern Physics (англ.). 39 (4): 883—893. Bibcode:1967RvMP...39..883B. doi:10.1103/RevModPhys.39.883.

- ↑ Amari, Shun-Ichi (1972). Learning patterns and pattern sequences by self-organizing nets of threshold elements. IEEE Transactions (англ.). C (21): 1197—1206.

- ↑ а б в г д е ж и к л м н п р Schmidhuber, Jürgen (2022). Annotated History of Modern AI and Deep Learning (англ.). arXiv:2212.11279 [cs.NE].

- ↑ Hopfield, J. J. (1982). Neural networks and physical systems with emergent collective computational abilities. Proceedings of the National Academy of Sciences (англ.). 79 (8): 2554—2558. Bibcode:1982PNAS...79.2554H. doi:10.1073/pnas.79.8.2554. PMC 346238. PMID 6953413.

- ↑ Tappert, Charles C. (2019). Who Is the Father of Deep Learning?. 2019 International Conference on Computational Science and Computational Intelligence (CSCI) (англ.). IEEE. с. 343—348. doi:10.1109/CSCI49370.2019.00067. ISBN 978-1-7281-5584-5. S2CID 216043128. Процитовано 31 травня 2021.

- ↑ а б в Rosenblatt, Frank (1962). Principles of Neurodynamics (англ.). Spartan, New York.

- ↑ а б Rina Dechter[en] (1986). Learning while searching in constraint-satisfaction problems. University of California, Computer Science Department, Cognitive Systems Laboratory.Online [Архівовано 2016-04-19 у Wayback Machine.] (англ.)

- ↑ Fradkov, Alexander L. (1 січня 2020). Early History of Machine Learning. IFAC-PapersOnLine. 21st IFAC World Congress (англ.). 53 (2): 1385—1390. doi:10.1016/j.ifacol.2020.12.1888. ISSN 2405-8963. S2CID 235081987.

- ↑ Ivakhnenko, A. G.; Lapa, V. G. (1967). Cybernetics and Forecasting Techniques (англ.). American Elsevier Publishing Co. ISBN 978-0-444-00020-0.

- ↑ а б Ivakhnenko, Alexey (1971). Polynomial theory of complex systems (PDF). IEEE Transactions on Systems, Man, and Cybernetics (англ.). SMC-1 (4): 364—378. doi:10.1109/TSMC.1971.4308320. Архів (PDF) оригіналу за 29 серпня 2017. Процитовано 5 листопада 2019.

- ↑ Robbins, H.; Monro, S. (1951). A Stochastic Approximation Method. The Annals of Mathematical Statistics (англ.). 22 (3): 400. doi:10.1214/aoms/1177729586.

- ↑ Amari, Shun'ichi (1967). A theory of adaptive pattern classifier. IEEE Transactions (англ.). EC (16): 279—307.

- ↑ Matthew Brand (1988) Machine and Brain Learning. University of Chicago Tutorial Studies Bachelor's Thesis, 1988. Reported at the Summer Linguistics Institute, Stanford University, 1987 (англ.)

- ↑ Linnainmaa, Seppo (1970). The representation of the cumulative rounding error of an algorithm as a Taylor expansion of the local rounding errors (Masters) (фін.). University of Helsinki. с. 6—7.

- ↑ Linnainmaa, Seppo (1976). Taylor expansion of the accumulated rounding error. BIT Numerical Mathematics (англ.). 16 (2): 146—160. doi:10.1007/bf01931367. S2CID 122357351.

- ↑ Griewank, Andreas (2012). Who Invented the Reverse Mode of Differentiation? (PDF). Documenta Mathematica (англ.) (Extra Volume ISMP): 389—400. Архів оригіналу (PDF) за 21 липня 2017. Процитовано 11 червня 2017.

- ↑ Leibniz, Gottfried Wilhelm Freiherr von (1920). The Early Mathematical Manuscripts of Leibniz: Translated from the Latin Texts Published by Carl Immanuel Gerhardt with Critical and Historical Notes (Leibniz published the chain rule in a 1676 memoir) (англ.). Open court publishing Company. ISBN 9780598818461.

- ↑ Kelley, Henry J. (1960). Gradient theory of optimal flight paths. ARS Journal (англ.). 30 (10): 947—954. doi:10.2514/8.5282.

- ↑ Werbos, Paul (1982). Applications of advances in nonlinear sensitivity analysis. System modeling and optimization (англ.). Springer. с. 762—770.

- ↑ Werbos, P. (1974). Beyond Regression: New Tools for Prediction and Analysis in the Behavioral Sciences. Harvard University (англ.). Процитовано 12 червня 2017.

- ↑ Rumelhart, David E., Geoffrey E. Hinton, and R. J. Williams. "Learning Internal Representations by Error Propagation [Архівовано 2022-10-13 у Wayback Machine.]". David E. Rumelhart, James L. McClelland, and the PDP research group. (editors), Parallel distributed processing: Explorations in the microstructure of cognition, Volume 1: Foundation. MIT Press, 1986. (англ.)

- ↑ Fukushima, K. (1980). Neocognitron: A self-organizing neural network model for a mechanism of pattern recognition unaffected by shift in position. Biol. Cybern. (англ.). 36 (4): 193—202. doi:10.1007/bf00344251. PMID 7370364. S2CID 206775608.

- ↑ Ramachandran, Prajit; Barret, Zoph; Quoc, V. Le (16 жовтня 2017). Searching for Activation Functions (англ.). arXiv:1710.05941 [cs.NE].

- ↑ Aizenberg, I.N.; Aizenberg, N.N.; Vandewalle, J. (2000). Multi-Valued and Universal Binary Neurons (англ.). Science & Business Media. doi:10.1007/978-1-4757-3115-6. ISBN 978-0-7923-7824-2. Процитовано 27 грудня 2023.

- ↑ Co-evolving recurrent neurons learn deep memory POMDPs. Proc. GECCO, Washington, D. C., pp. 1795–1802, ACM Press, New York, NY, USA, 2005. (англ.)

- ↑ а б Zhang, Wei (1988). Shift-invariant pattern recognition neural network and its optical architecture. Proceedings of Annual Conference of the Japan Society of Applied Physics (англ.).

- ↑ Zhang, Wei (1990). Parallel distributed processing model with local space-invariant interconnections and its optical architecture. Applied Optics (англ.). 29 (32): 4790—7. Bibcode:1990ApOpt..29.4790Z. doi:10.1364/AO.29.004790. PMID 20577468.

- ↑ а б LeCun et al., "Backpropagation Applied to Handwritten Zip Code Recognition", Neural Computation, 1, pp. 541–551, 1989. (англ.)

- ↑ Zhang, Wei (1991). Image processing of human corneal endothelium based on a learning network. Applied Optics (англ.). 30 (29): 4211—7. Bibcode:1991ApOpt..30.4211Z. doi:10.1364/AO.30.004211. PMID 20706526.

- ↑ Zhang, Wei (1994). Computerized detection of clustered microcalcifications in digital mammograms using a shift-invariant artificial neural network. Medical Physics (англ.). 21 (4): 517—24. Bibcode:1994MedPh..21..517Z. doi:10.1118/1.597177. PMID 8058017.

- ↑ LeCun, Yann; Léon Bottou; Yoshua Bengio; Patrick Haffner (1998). Gradient-based learning applied to document recognition (PDF). Proceedings of the IEEE (англ.). 86 (11): 2278—2324. CiteSeerX 10.1.1.32.9552. doi:10.1109/5.726791. S2CID 14542261. Процитовано 7 жовтня 2016.

- ↑ а б в Schmidhuber, Jürgen (1992). Learning complex, extended sequences using the principle of history compression (based on TR FKI-148, 1991) (PDF). Neural Computation (англ.). 4 (2): 234—242. doi:10.1162/neco.1992.4.2.234. S2CID 18271205.

{{cite journal}}: Обслуговування CS1: Сторінки з параметром url-status, але без параметра archive-url (посилання) - ↑ Schmidhuber, Jürgen (1993). Habilitation Thesis (PDF) (нім.). Архів оригіналу (PDF) за 26 червня 2021.

- ↑ Schmidhuber, Jürgen (1 листопада 1992). Learning to control fast-weight memories: an alternative to recurrent nets. Neural Computation (англ.). 4 (1): 131—139. doi:10.1162/neco.1992.4.1.131. S2CID 16683347.

- ↑ а б Schlag, Imanol; Irie, Kazuki; Schmidhuber, Jürgen (2021). Linear Transformers Are Secretly Fast Weight Programmers. ICML 2021 (англ.). Springer. с. 9355—9366.

- ↑ Choromanski, Krzysztof; Likhosherstov, Valerii; Dohan, David; Song, Xingyou; Gane, Andreea; Sarlos, Tamas; Hawkins, Peter; Davis, Jared; Mohiuddin, Afroz; Kaiser, Lukasz; Belanger, David; Colwell, Lucy; Weller, Adrian (2020). Rethinking Attention with Performers (англ.). arXiv:2009.14794 [cs.CL].

- ↑ Schmidhuber, Jürgen (1993). Reducing the ratio between learning complexity and number of time-varying variables in fully recurrent nets. ICANN 1993 (англ.). Springer. с. 460—463.

- ↑ Vaswani, Ashish; Shazeer, Noam; Parmar, Niki; Uszkoreit, Jakob; Jones, Llion; Gomez, Aidan N.; Kaiser, Lukasz; Polosukhin, Illia (12 червня 2017). Attention Is All You Need (англ.). arXiv:1706.03762 [cs.CL].